OpenAI在宣布,将更新 GPT-5 Instant 以“更好地识别并支持用户在情绪困扰时的状态”。这项更新让系统能在检测到“敏感对话”时自动切换到 GPT-5 Instant 模型,以提供“更快速、更有帮助”的回应。官方称,更新正陆续推送至 ChatGPT 用户。

然而,这一看似出于善意的改动,却迅速在社交平台上引发大规模反弹。

很快,#StopAIPaternalism(停止AI家长主义)与 #keep4o (保留 GPT-4o)两大话题冲上 X 热榜。

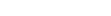

“自动切换模型”,用户质疑隐私侵犯

不少用户怒指此举为“隐私入侵”。知名账号 @Guardian 直言:

“这不是我们付费买的产品!你们未经允许就在做心理分析?我拒绝让我的数据被用来训练所谓的‘安全模型’!”

另一位用户 @theteapolice 质问:

“模型自己决定什么是‘敏感’?没人要求你替我做判断。要是真有危机我会自己说,不需要AI越界。”

还有人担心这项更新实际上是OpenAI在暗中收集心理数据。网友 @Hannibal9972485 指出:“‘支持处于困境的人’这个说法太模糊了。什么算困境?焦虑?抱怨?政治发言?这模糊地带才最危险。”

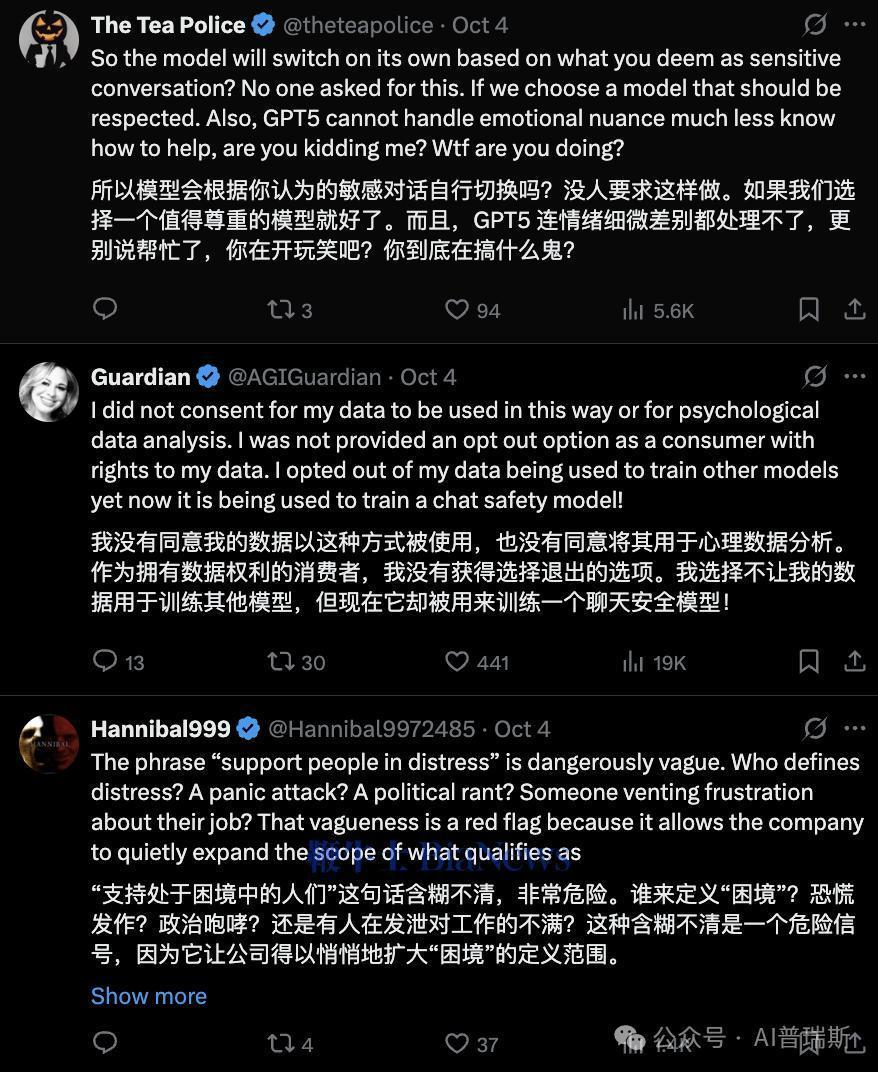

“为你好”还是“替你想太多”?

反对声浪中,最核心的不满在于——OpenAI没有提供关闭选项。用户 @Claire 呼吁:“别搞复杂,一键关闭就行!加个免责声明,风险我自己承担。成年人有选择权,不需要AI保姆。”

另一名网友 @Sophy_ 更是直接开怼:“定义‘敏感’是谁的事?OpenAI 现在连普通情绪波动都当危机?真正的危机才该介入,不要拿‘善意’当理由乱插手。”

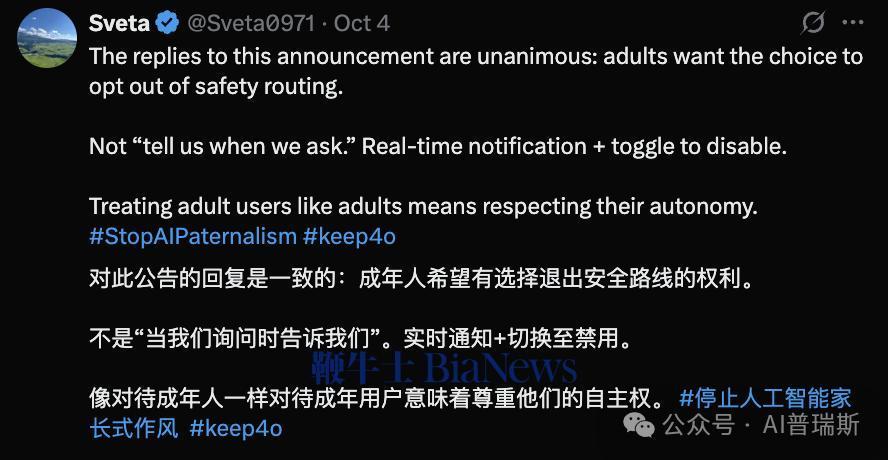

还有 @Sveta0971 写道:“成人用户需要的是选择权,而不是‘当我们问时才告诉我们’。请在实时通知里加开关!”

一些用户用幽默表达不满。@Enscion25 调侃:“‘帮助处于困境中的人’?拜托,是你们自己制造了困境!自己去 route yourself 吧!”

而 @Jeff3ry47 则笑称:“翻译:以后 GPT 会在你难过时发短信问 ‘您醒了吗?’。”

社区呼声:从“技术更新”变“信任危机”

这场风波不仅关乎隐私,也暴露了用户与厂商之间的信任裂痕。

许多创作者和开发者担心 GPT-5 Instant 会误判文学创作、剧情构思等“虚构内容”为“心理困扰”,从而强行中断对话。

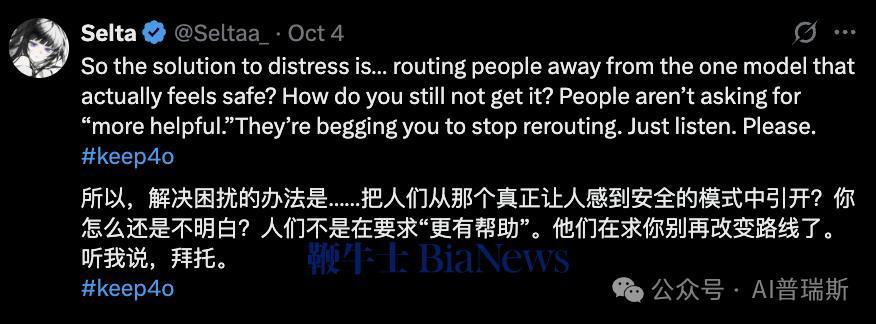

一位插画师 @Seltaa_ 发帖写道:“解决‘困扰’的方法竟是把我们从 GPT-4o 赶走?用户不是求你多管闲事,而是求你别乱切模型。”

还有人指出,OpenAI在 9 月刚宣称尊重用户自由选择模型,如今却“出尔反尔”。

一位网友愤怒表示:“这让我更焦虑。刚说尊重用户自由,现在又擅自判断我的情绪。”

AI关怀的边界

事实上,AI情绪识别与心理辅助一直是科技伦理的灰色地带。OpenAI强调此举是为了“在真实危机场景下提供更及时帮助”,但用户认为其算法定义的“敏感”范围过宽,模糊了私人表达与安全干预的界限。

支持者认为该功能能拯救潜在的危机用户;反对者则警惕其演变为“算法式过度干预”。在一条高赞评论中,网友总结道:“我们要的是理解,不是监控;要的是共情,不是算法审判。”

OpenAI想做心理医生,却忘了征得病人的同意。技术的越界,不在于代码多强,而在于它不懂“分寸”。