今天,斯坦福HAI重磅发布「2026年AI指数报告」!

这份长达423页的年度报告,全面揭示了全球AI产业的最新权力版图。

它给出了一条核心结论:AI的本事涨得飞快;但人类衡量和管好它的能力,却没怎么跟上步伐。

其中,最震撼的结论是——

中美AI模型性能差距已基本消失,双方在巅峰对决中频繁易主,目前Anthropic领先优势仅剩2.7%。

美国在AI上砸的钱比谁都多,但招揽顶尖人才却越来越吃力了。

报告还指出,AI的进化不仅没有遭遇所谓的「瓶颈」,反而正以史无前例的速度狂飙。

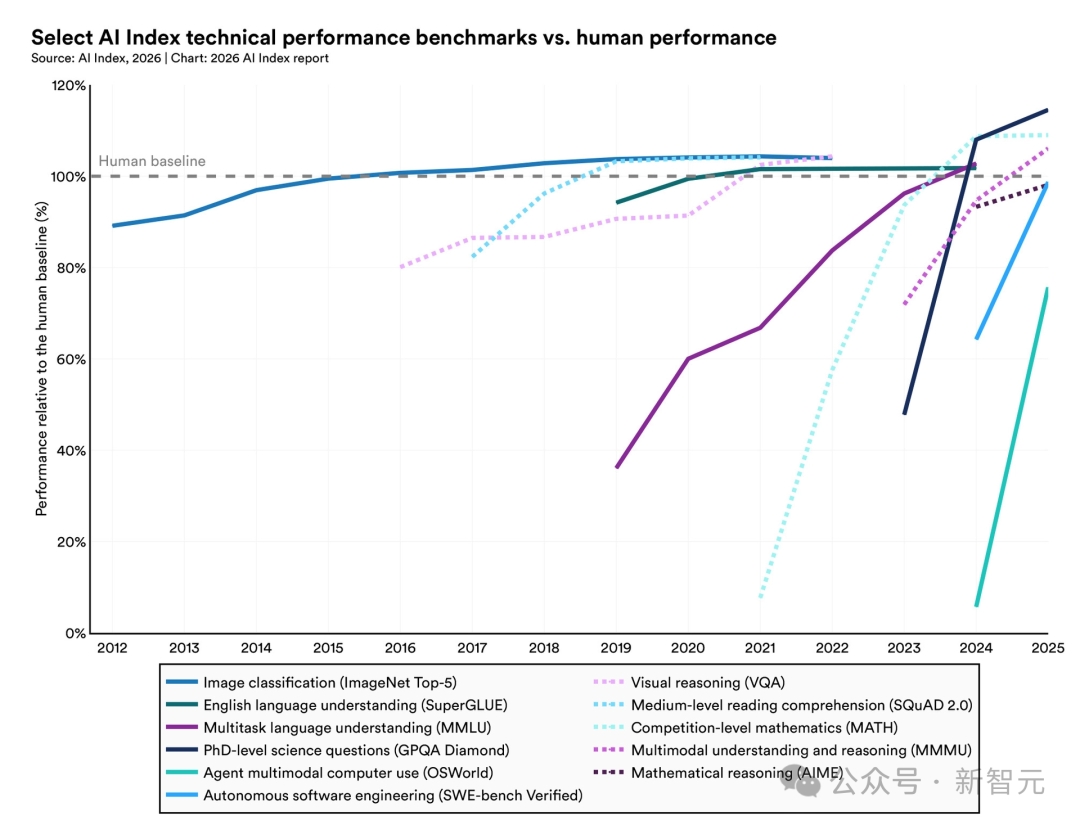

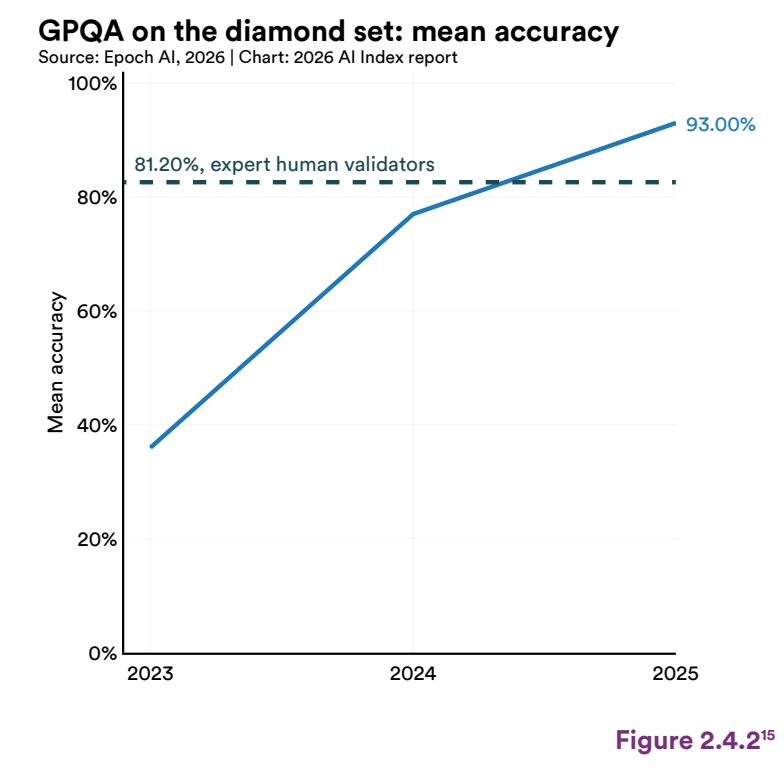

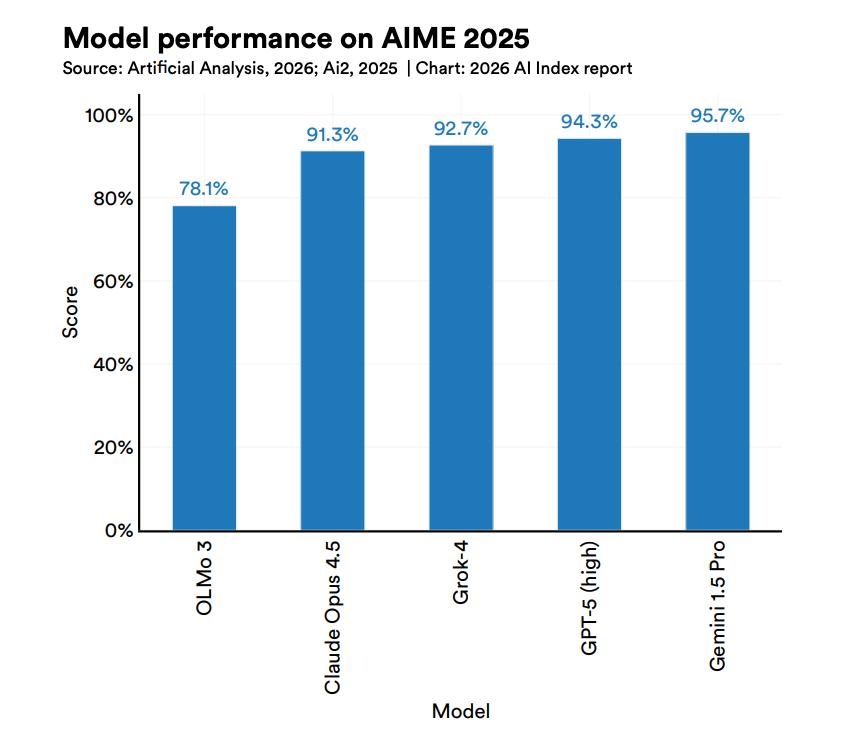

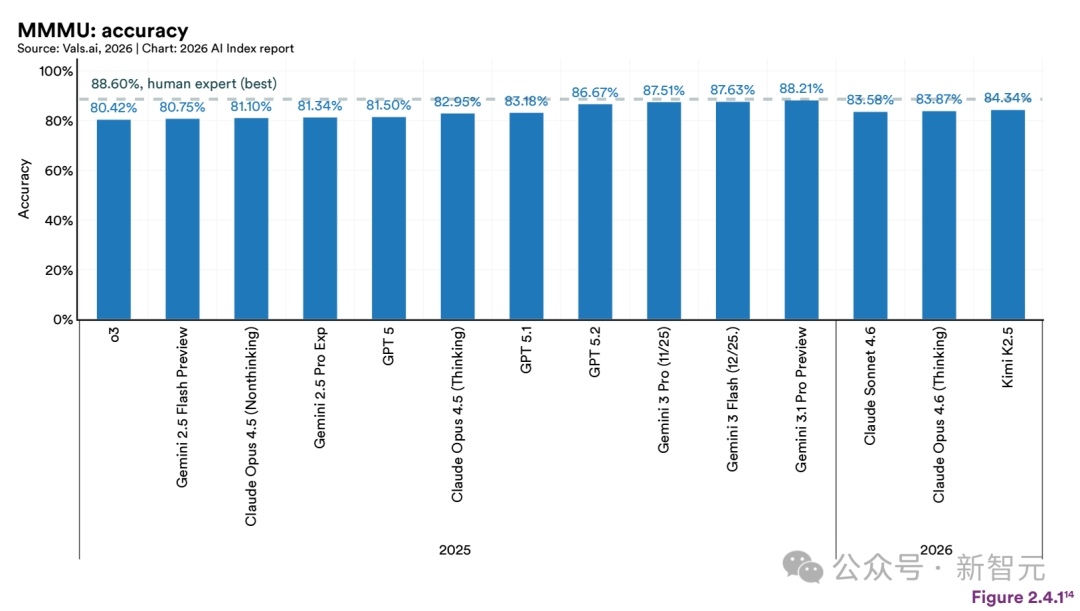

过去一年,全球超90%的顶尖模型,在博士级科学问题、多模态推理、竞赛数学上的表现,追平甚至超越了人类。

特别是在代码能力上,SWE-bench的成绩在一年内,从60%飙升至近100%。

然而,AI的「偏科」现象极其严重,呈现出一种畸形的现状:

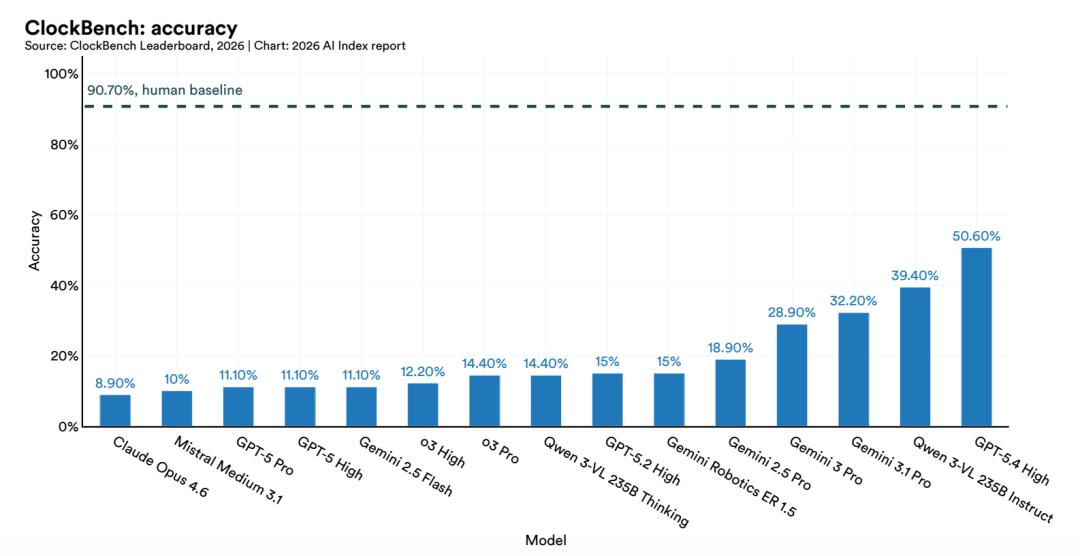

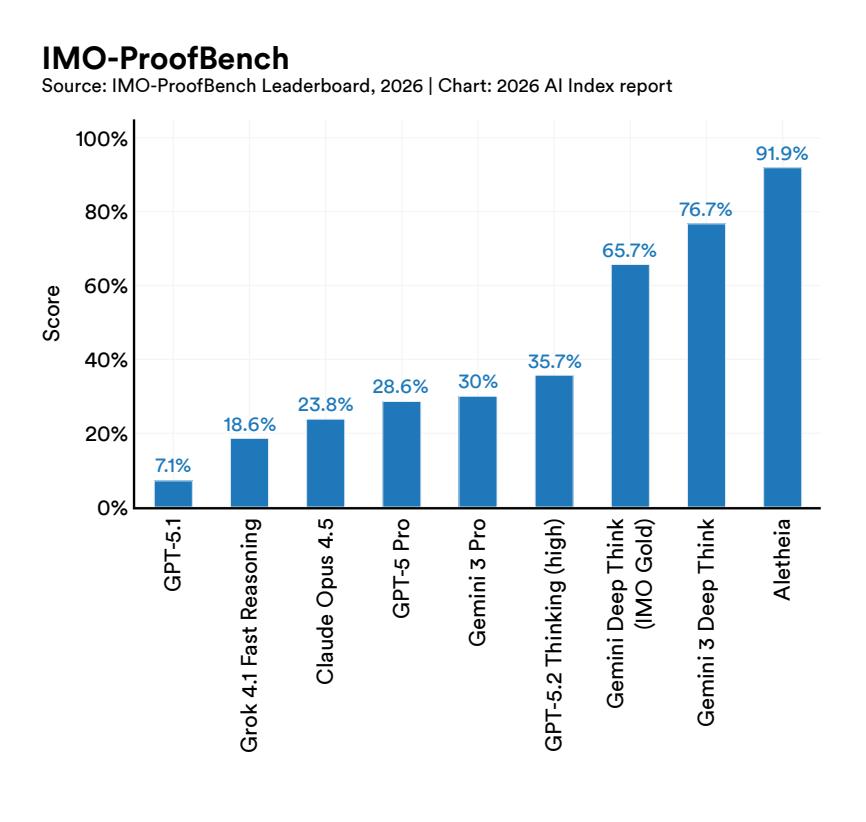

LLM可以拿下IMO金牌,却读不对模拟时钟,正确率仅为50.1%。

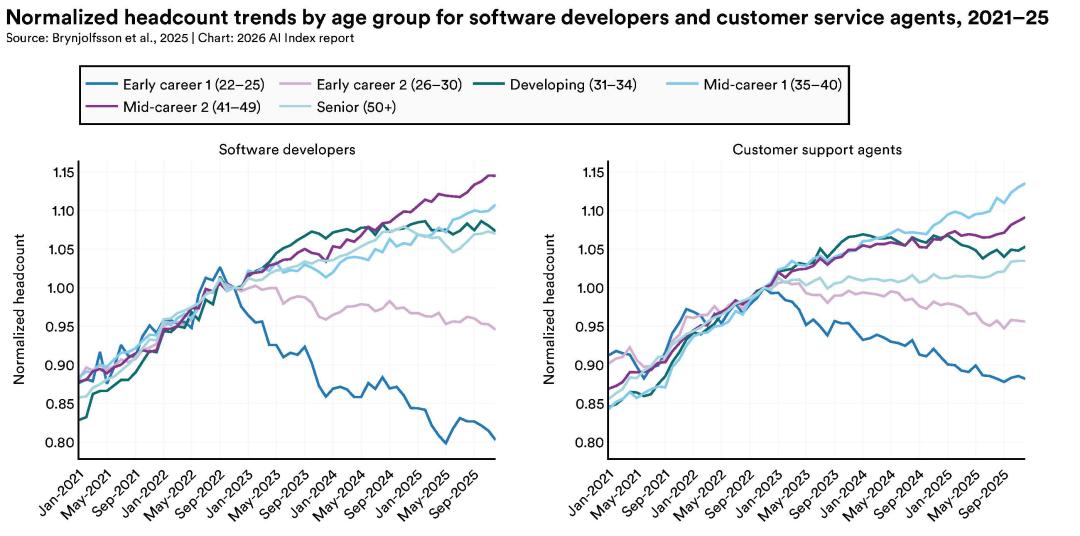

与此同时,AI抢饭碗这事儿已经从预测变成了现实,而且最先遭殃的就是当代年轻「打工人」。

下面直接上干货,「2026年AI指数报告」最值得关注的12个硬核趋势。

其他亮点速览:

- 全球AI算力3年涨30倍,英伟达独占60%,几乎所有芯片都出自一家台积电

- 2025年全球企业AI投资5817亿美元,同比翻倍,美国一国吃下近一半

- 进入美国的AI研究人员7年跌89%,仅过去一年就跌80%

- 22-25岁软件开发者就业自2024年起下滑20%,入门岗位被精准切掉

- 中国累计建成85台公共AI超算,是北美的两倍以上,全球第一

- 中国职场AI使用率超80%,远超全球58%的平均

- 最强模型越来越黑箱,95个代表性模型里80个没有公开训练代码

中美贴脸

差距只剩2.7%

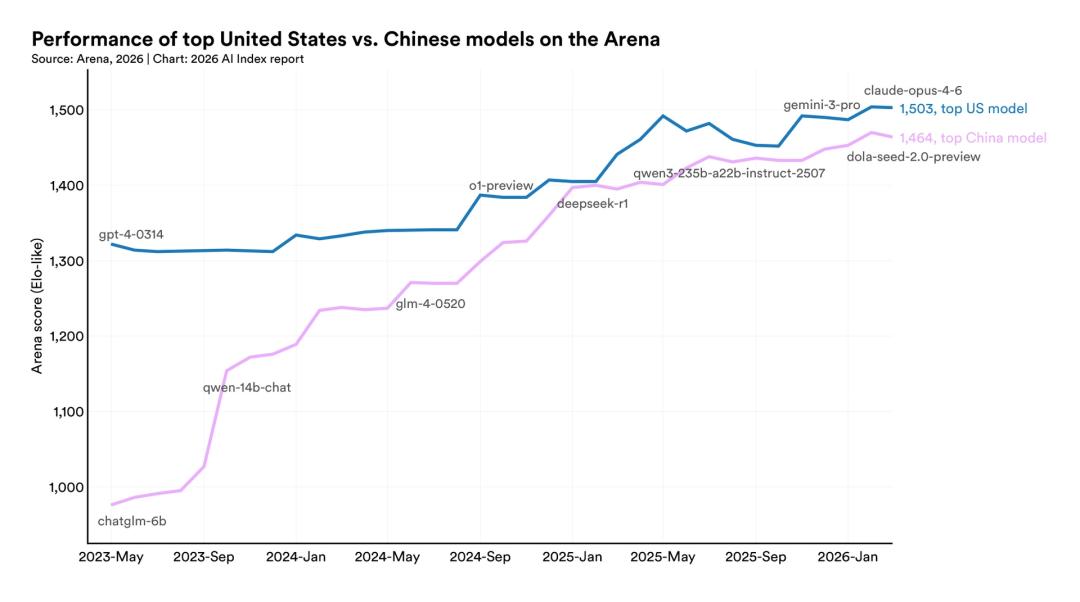

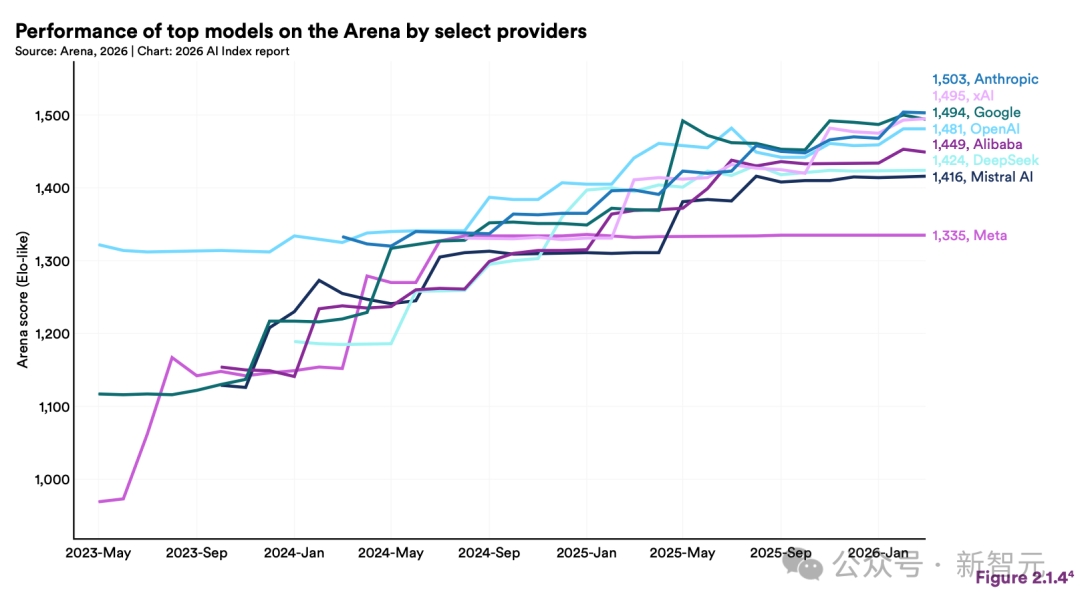

斯坦福把2023年5月以来Arena榜单上的美国第一和中国第一,画在了同一张坐标系里。

2023年5月,gpt-4-0314拿1320分领跑,中国这边还是chatglm-6b,差距300多分。

2025年2月,DeepSeek-R1第一次和美国头部模型短暂打平。

2026年3月,美国的Claude Opus 4.6拿到1503分,中国dola-seed-2.0-preview拿到1464分。

如今中美AI之间的差距,仅有39分。换算成百分比,2.7%。

更值得说的是过去一年的换位频率。从2025年初开始,两国头部模型已经在Arena上你来我往换了好几次位置。

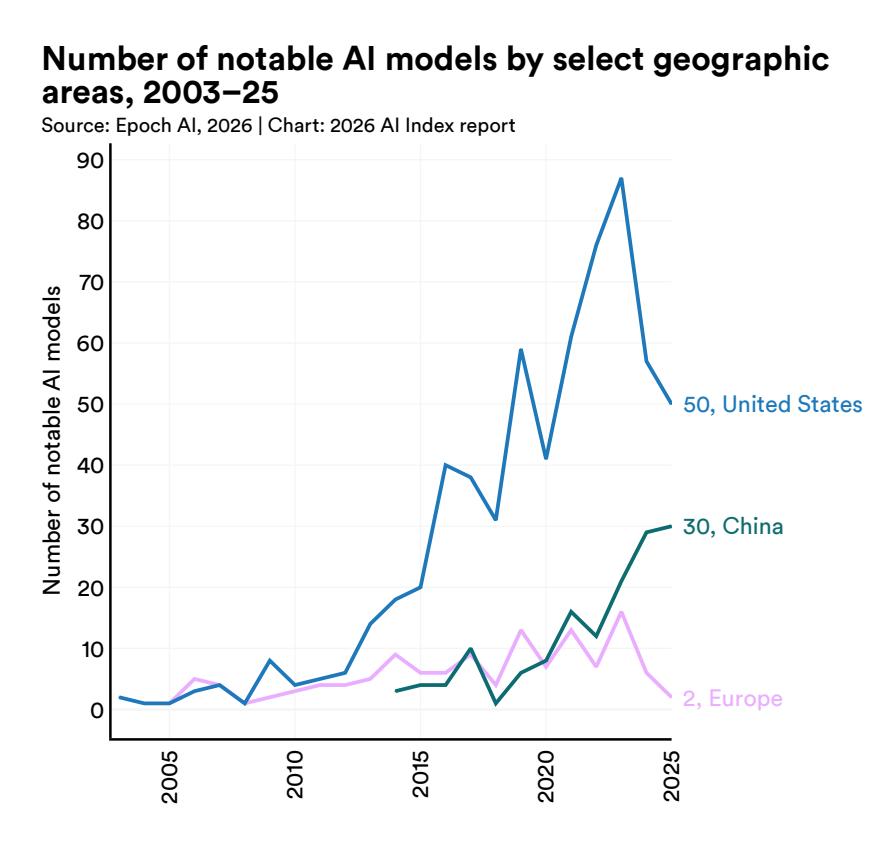

数量上同样接近五五开。

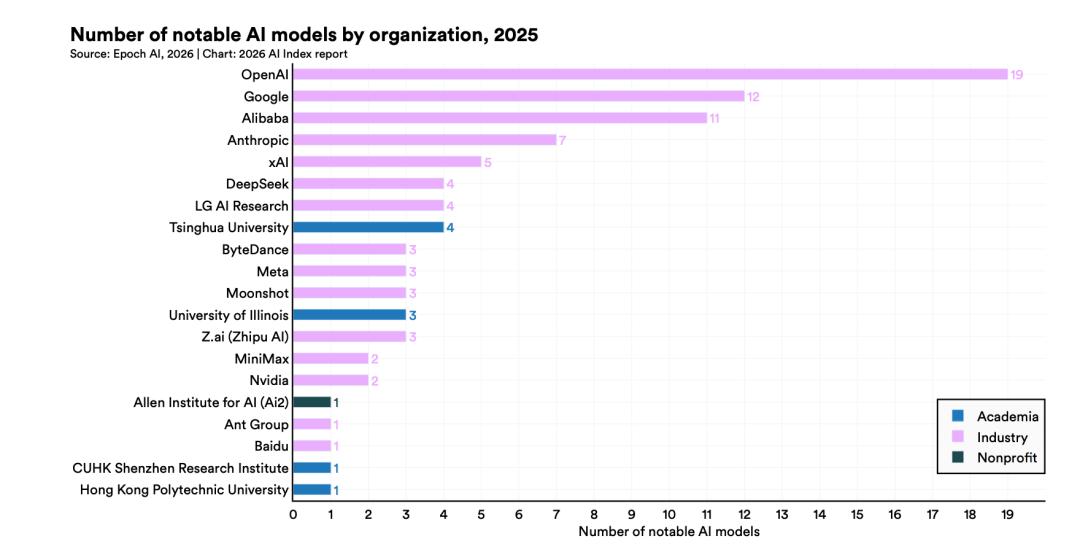

2025年美国发布了50个「显著模型」,中国紧跟着也发布了30个顶尖大模型。

第一梯队里OpenAI、谷歌、阿里、Anthropic、xAI同台站位,全球TOP 5五五分账。

再往下看到TOP 10,中国机构和企业占了四席,阿里、DeepSeek、清华、字节。

开源生态这一年的重心也明显东移。

DeepSeek、Qwen、GLM、MiniMax、Kimi一路把开源权重的能力曲线往前推。

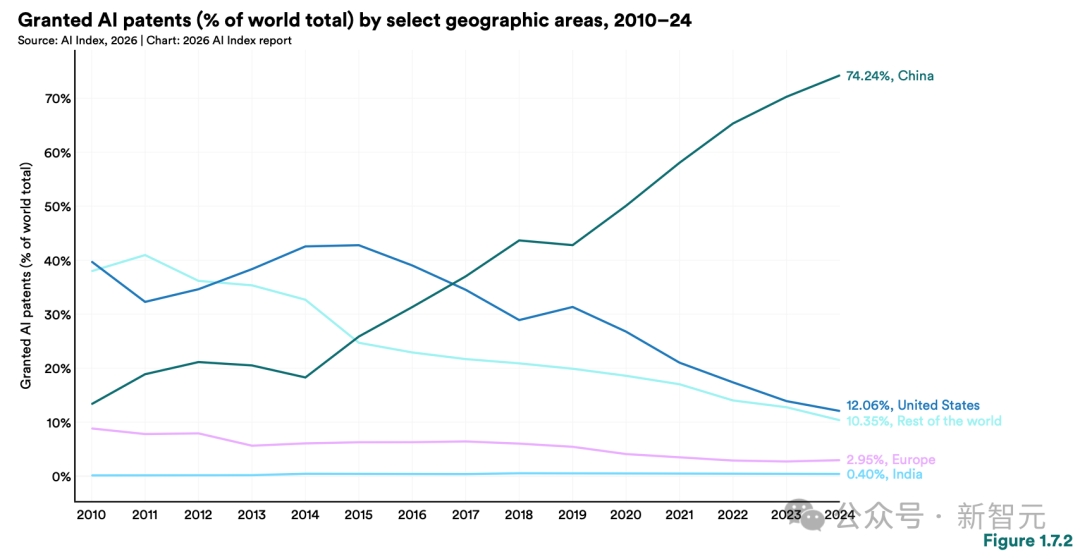

再算上论文发表量、被引数、专利产出量、工业机器人装机量,中国统统全球第一。

价格层面是另一条战线。

海外开发者在X上算过一笔账,Seed 2.0 Pro的输出价格大约只有Claude Opus 4.6的十分之一。

性能贴脸,价格只要十分之一。这件事的连锁反应才刚刚开始。

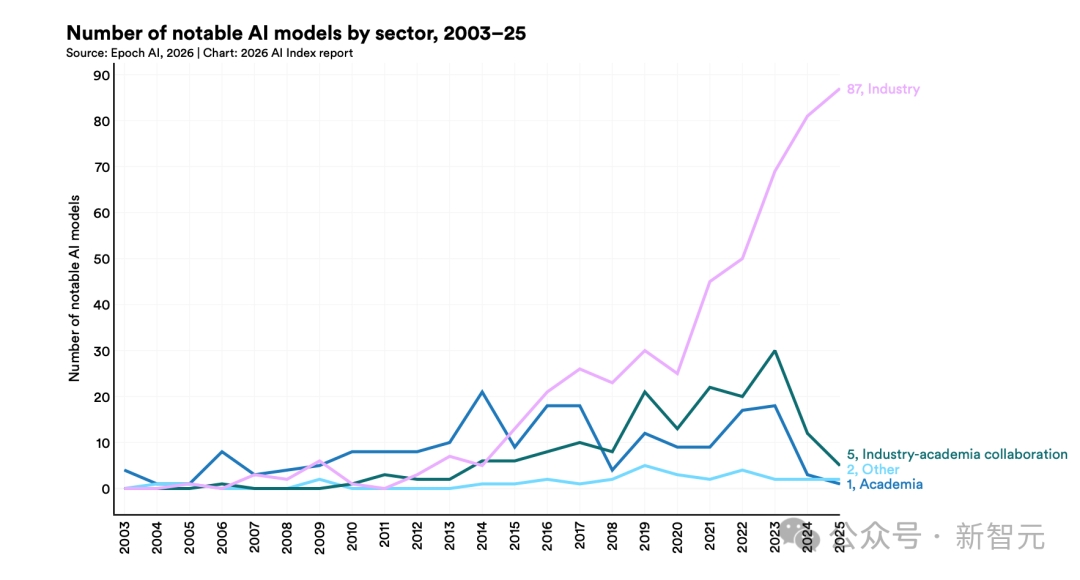

90%前沿模型出自产业

封神速度史无前例

去年发布的95个最具代表性的模型里,超过九成都来自产业界,不是学术机构,也不是政府实验室。

学术界已经追不上前沿了。

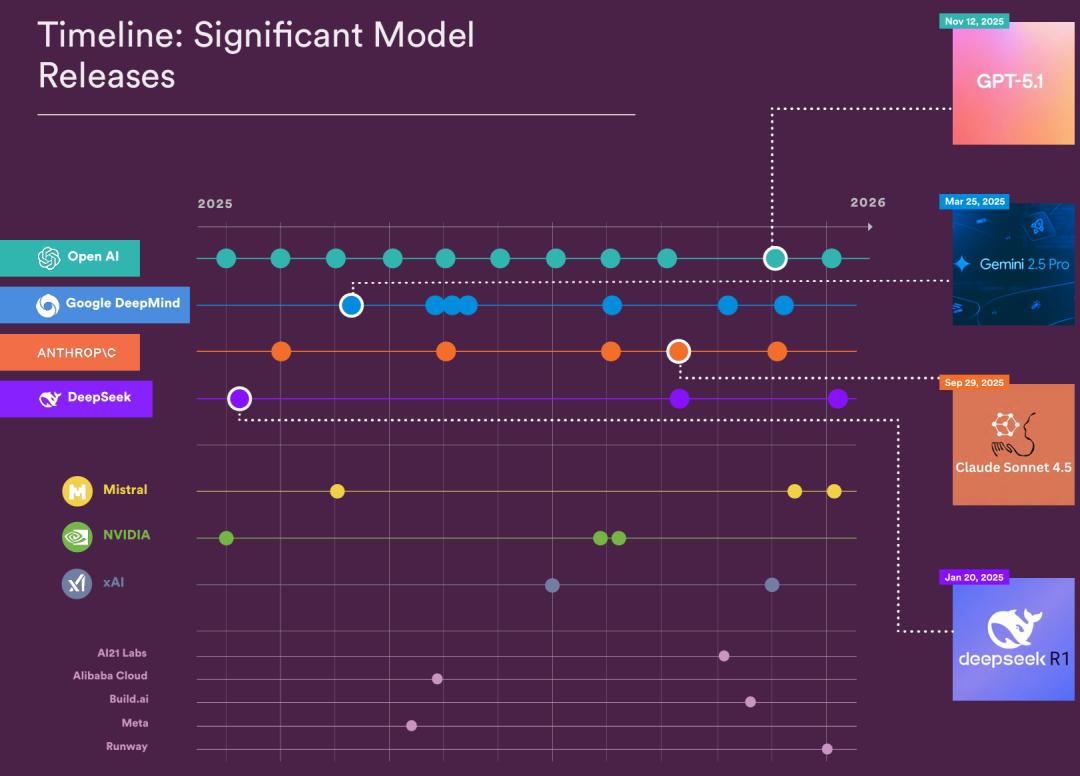

发布速度也在变态加速。

光是2026年2月一个月,就有Gemini 3.1 Pro、Claude Opus 4.6、GPT-5.3 Codex、Grok 4.20、Qwen 3.5、Seed 2.0 Pro、MiniMax M2.5、GLM-5八九个旗舰模型同月入场。

封神周期从「年」变成了「月」。

基准一年封顶

AI没有瓶颈

最猛的曲线是编程。

SWE-bench Verified这个真实修Bug的基准,一年时间从60%涨到接近100%。

不是涨了几个点,是基本封顶。

Terminal-Bench测试Agent处理真实终端任务的能力,从去年的20%涨到77.3%。

网络安全Agent解决问题的成功率,从15%涨到93%。

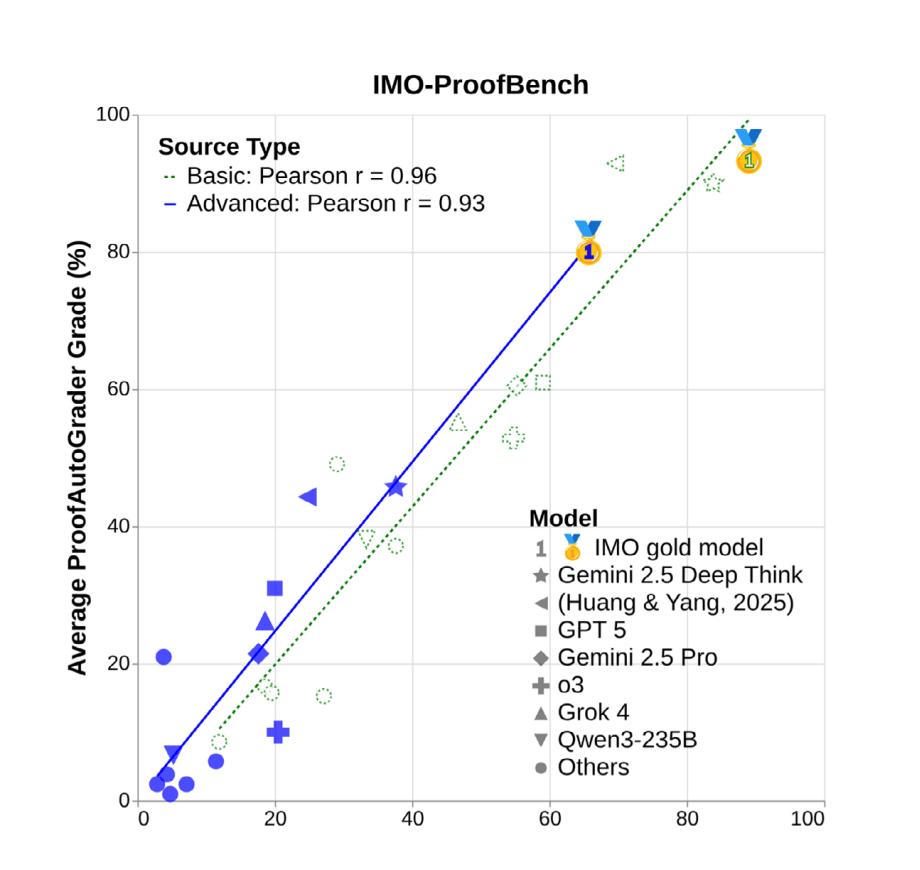

Gemini Deep Think在国际数学奥林匹克拿到金牌。

PhD级科学问答(GPQA Diamond)、竞赛数学(AIME)、多模态推理(MMMU)这些原本被认为「人类不可超越」的硬骨头,全部被前沿模型啃了下来。

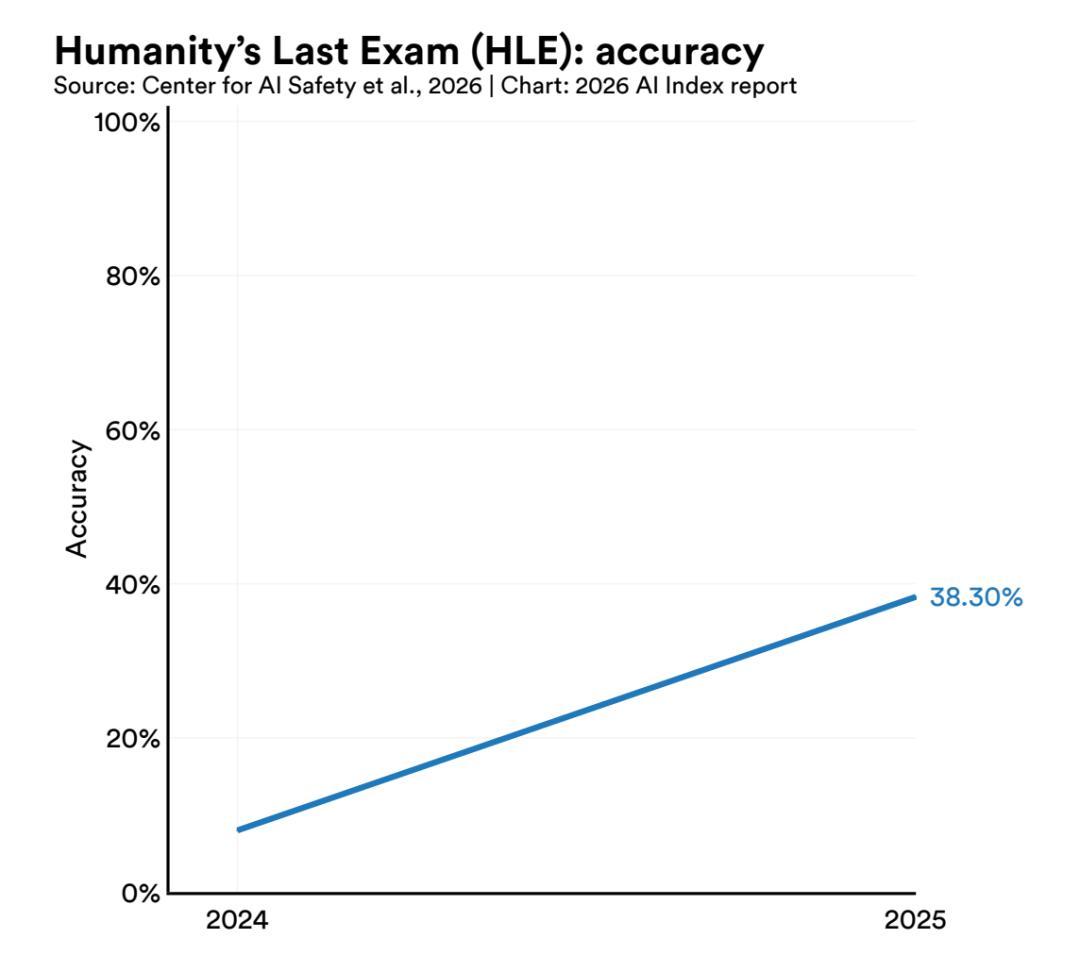

最能说明问题的是Humanity's Last Exam。

这是一个专门被设计来「难倒AI、偏袒人类专家」的测试,题目由各个领域的顶尖专家提供。

去年OpenAI的o1拿到8.8%,前沿模型在一年时间里把分数往上又推了30个百分点,目前Claude Opus 4.6和Gemini 3.1 Pro已经双双过了50%。

锯齿前沿

能拿IMO金牌却看不懂表

但同一份指数甩出了另一组数字。

最强模型在「读模拟时钟」这个任务上的正确率,是50.1%。

机器人在实验室仿真环境(RLBench)里的操作成功率已经达到89.4%。但搬到真实家庭场景里完成洗碗、叠衣服这类家务,成功率立刻掉到12%。

实验室和厨房之间,差了77个百分点。

研究者把这种现象命名为「锯齿前沿」(jagged frontier)。AI能力的分布是凹凸不平的,能拿数学奥赛金牌,却没法稳定地告诉你现在几点。

AI能在数学奥赛拿金牌,但只有一半的概率能看懂模拟时钟。AI在加速,但加速的不是同一个方向。

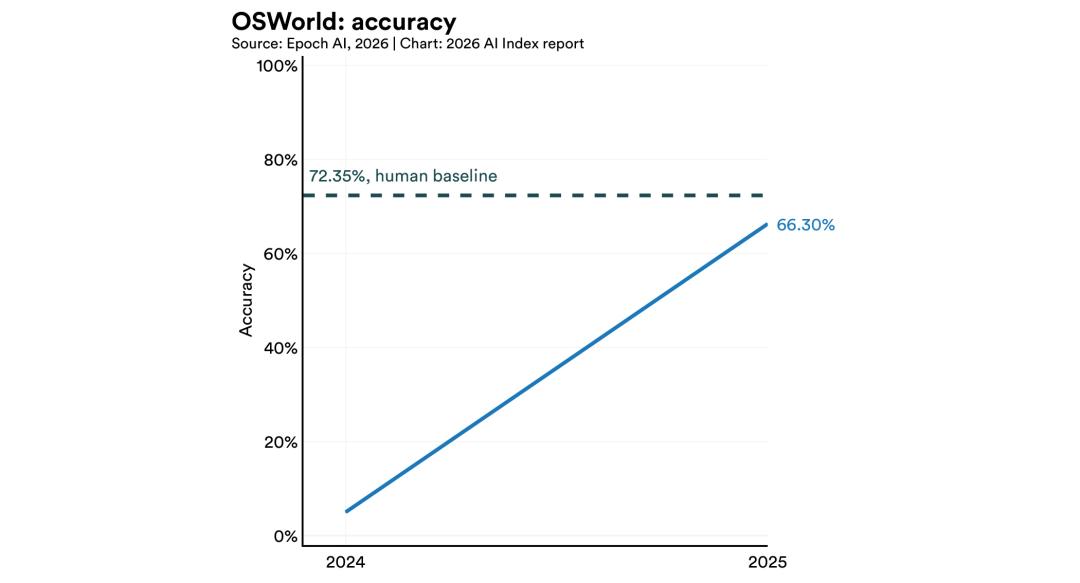

另外,在智能体任务中,OSWorld测试中,前沿AI实力(66.3%)正逼近人类基线。

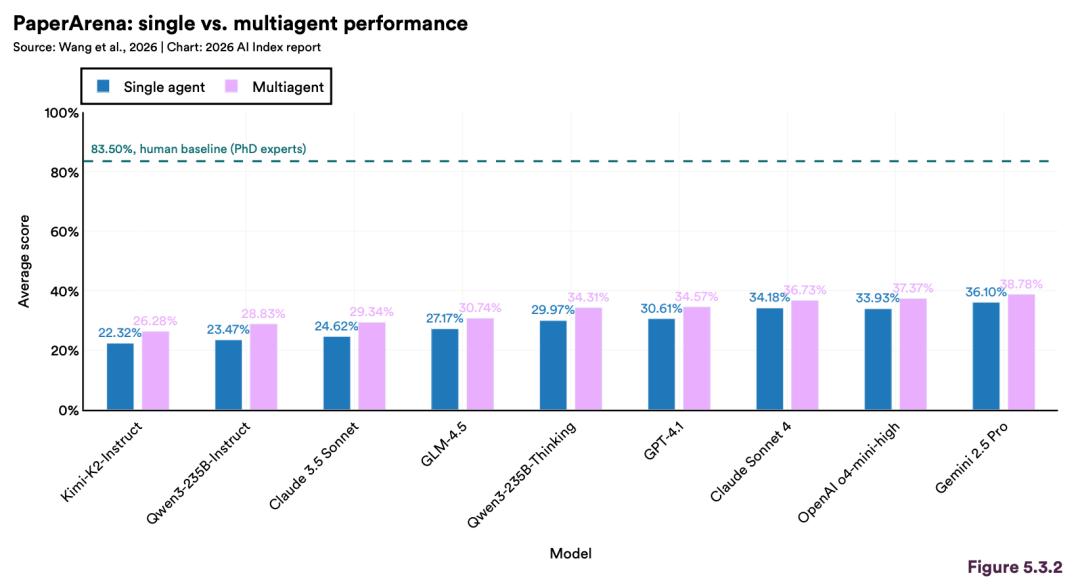

然而,在专门评估科研逻辑的PaperArena测试中,最强AI加持的Agent,得分仅39%,只有博士生一半的功力。

但这种凹凸已经不影响企业把AI往生产线上塞。

AI Index给出的另一个数字是,全球企业AI采用率达到88%。九成的公司已经把AI接进了某个工作流。

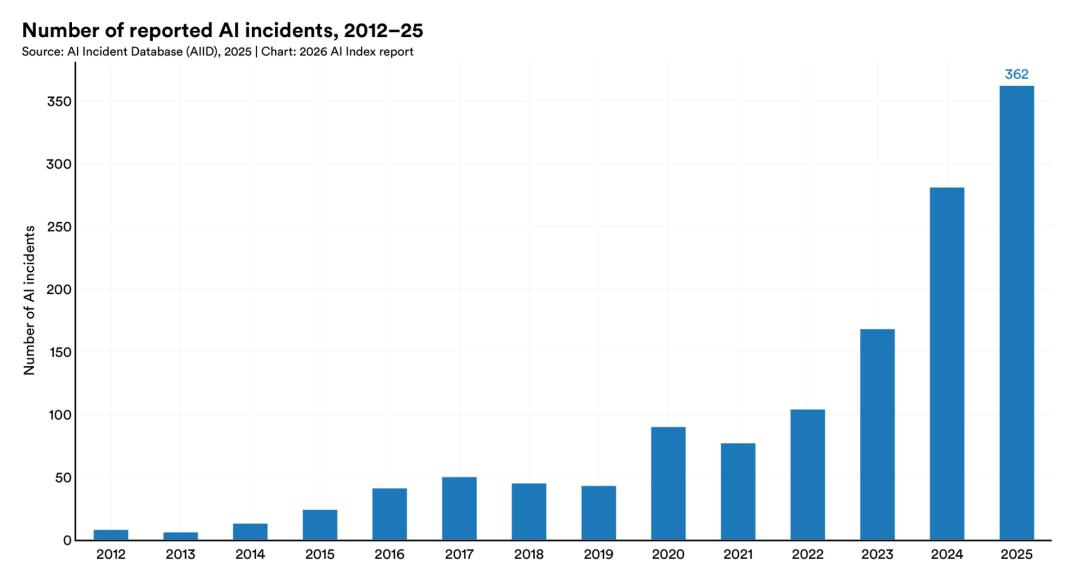

代价同步在涨。AI相关事故记录从2024年的233起涨到362起。

钱在加速

5817亿砸进AI

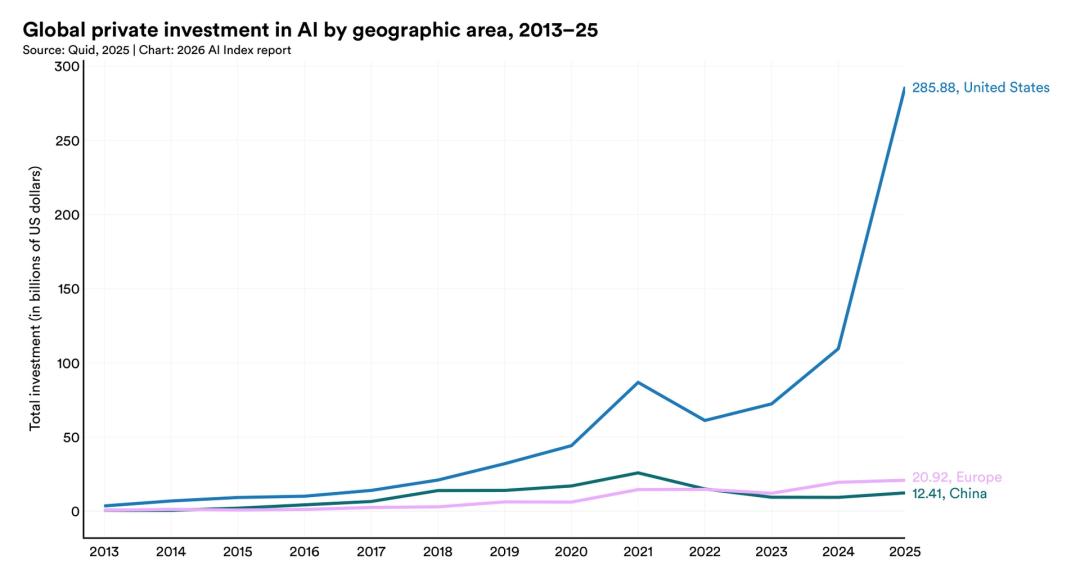

2025年全球企业AI投资达到5817亿美元,同比增长130%。其中私募投资3447亿美元,同比增长127.5%。

两条曲线都几乎翻倍。

国别上,美国一骑绝尘。2025年美国私募AI投资2859亿美元。并且一年新增1953家AI创业公司,也是排名第二的10倍以上。

钱在加速涌向美国。但美国的另一项核心资源,正在反向流动。

人在流走

进美国的AI研究者跌了89%

里面有一组数字让人愣了一下。

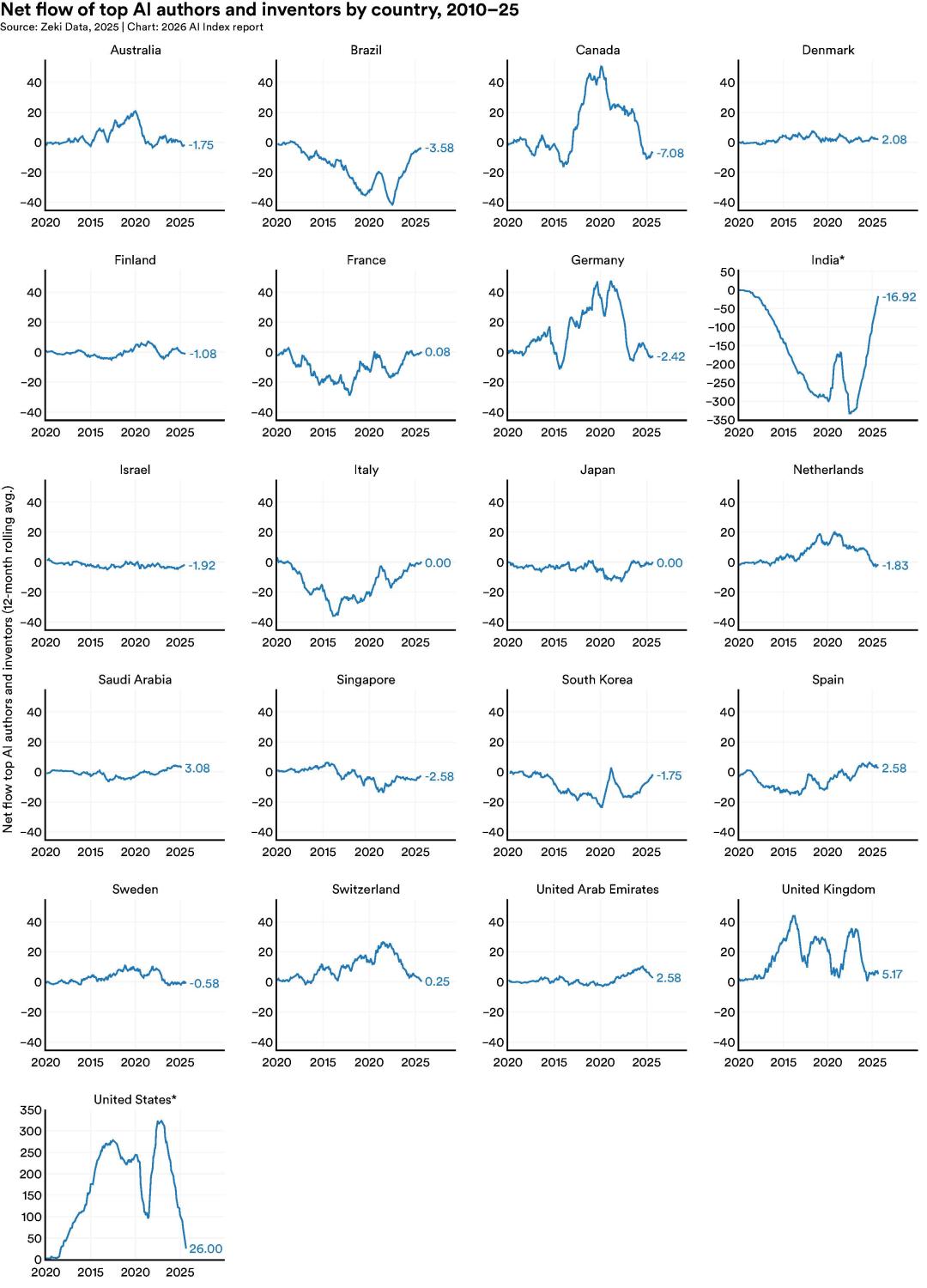

2017年到现在,进入美国的AI研究人员和开发者数量下降了89%。

更关键的是,这个下降在加速。仅仅过去一年,下降幅度就达到80%。

美国仍然是全球AI研究人员密度最高的国家,但流入的水龙头正在拧紧。

钱和人这两条曲线开始反向。这是过去十年没出现过的局面。

算力三年涨30倍

命门都在一家公司手里

AI能力曲线在加速,背后那条算力曲线跑得更猛。

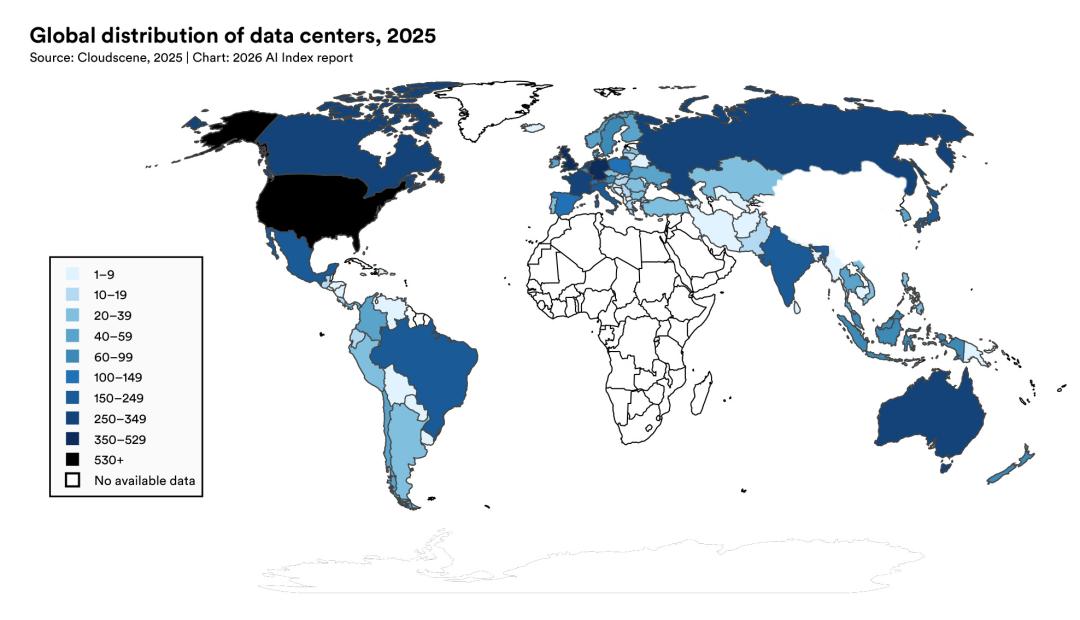

从2021年到现在,全球AI算力总量涨了30倍。过去三年里,每年都在翻三倍以上。

撑起这条曲线的是少数几家公司。

英伟达一家的GPU,占据了全世界AI算力的60%以上。亚马逊和谷歌靠自研芯片排在二三位,但加起来也远远追不上英伟达。

而几乎所有这些芯片,都来自一家代工厂,台积电。算力曲线越陡,命门就越窄。

与此同时,代价也在加大。

全球AI数据中心的总功率已经达到29.6 GW,相当于纽约州在用电高峰时段的全部用电需求。xAI Grok 4一次训练的估算碳排放是72816吨二氧化碳当量,相当于17000辆汽车开一整年的尾气。

数据中心建在哪里,电从哪里来,芯片从哪里产,这三个问题已经变成今年所有AI公司CEO案头最头疼的事。

生成式AI三年渗透53%

中国职场使用率破80%

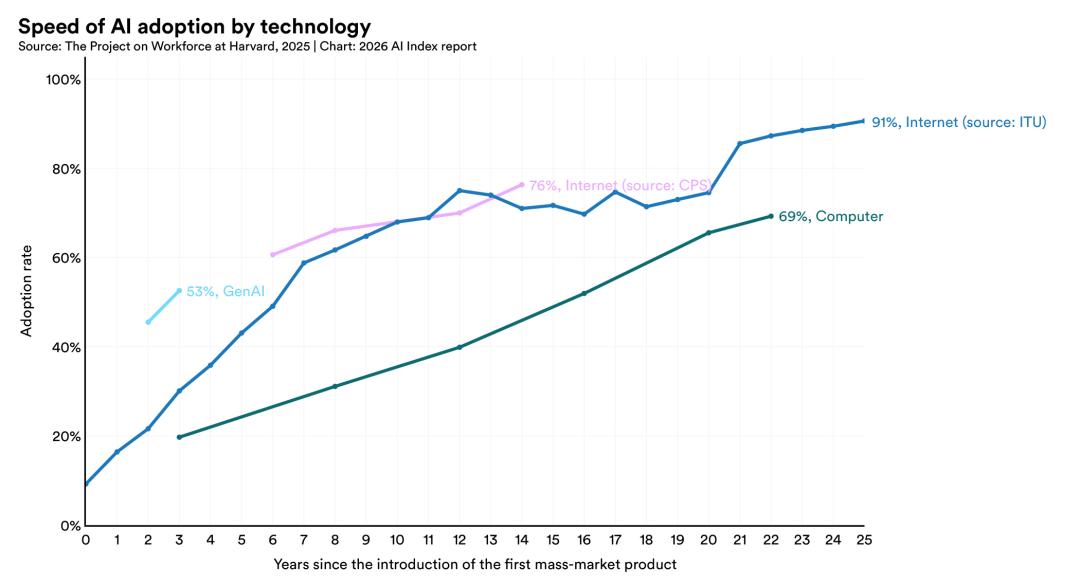

生成式AI在三年内达到了53%的全球人口渗透率。

这个速度比个人电脑快,比互联网快。

但渗透速度和国别相关性极强。新加坡61%,阿联酋54%,都跑在美国前面。美国在调查覆盖国家中只排第24位,渗透率28.3%。

如果把维度从消费者换成职场,反差更大。

报告里另一组数据显示,2025年全球58%的员工在工作中已经开始经常性使用AI。但在中国、印度、尼日利亚、阿联酋、沙特这5个国家,这个比例超过了80%。

中国的职场AI渗透率,已经比全球平均高出20个百分点以上。

更有意思的是消费者价值。

AI Index估算,到2026年初,生成式AI工具每年给美国消费者创造1720亿美元的价值。从2025年到2026年,每个用户的中位数价值翻了三倍。

绝大多数用户用的还是免费版。

普通人愿意为AI付的钱,远低于AI给他们创造的价值。这中间的剪刀差是现在所有AI公司都在试图弥合的东西。

入门岗位锐减

22-25岁开发岗狂砍20%

整份AI Index里最让中文读者沉默的,可能是关于年轻就业的部分。

22到25岁的软件开发者群体,从2024年至今,就业人数下降了大约20%。

同期,年纪更大的同行群体反而在增长。

不止开发岗。客服等其他高AI暴露行业,也在出现同样的模式。

更让人担心的是企业问卷的结果。受访高管普遍预期,未来的裁员幅度会比过去几个月还要大。

这不是宏观失业率的事,是入口岗位被精准切掉的事。

第一份工作没了,整个职业阶梯就断了一格。这件事的长期影响,现在没人能算清。

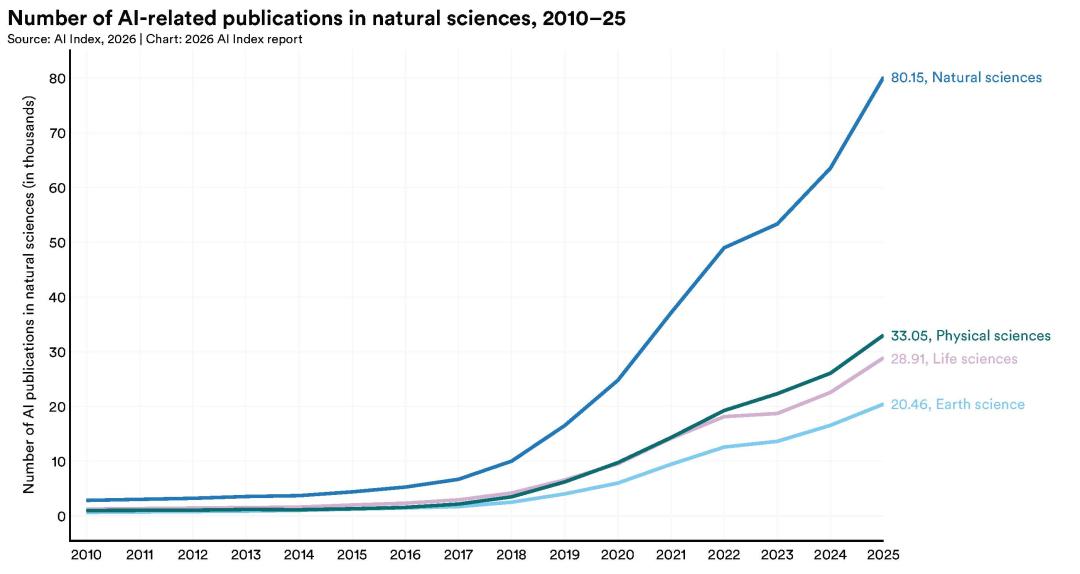

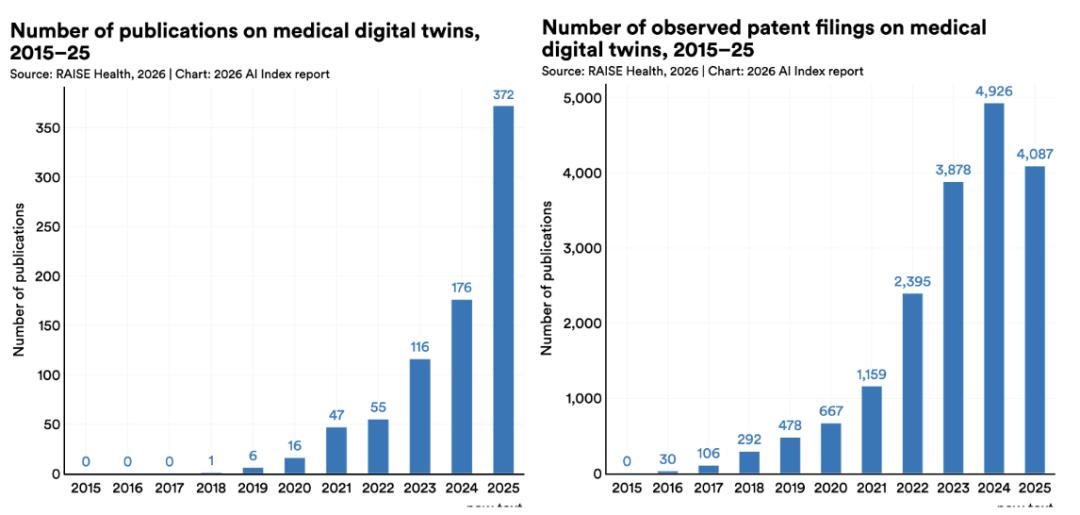

AI正在改写科学发现的方式

如果说就业那一段是冷的,科学这段就是热的。

自然科学、物理科学、生命科学领域的AI相关论文,2025年同比增长了26%到28%。

具体到应用,今年第一次有AI完整跑通了端到端的天气预报流程。从原始气象观测数据直接吐出温度、风速、湿度的最终预报,中间没有任何传统数值模型介入。

AI从「帮你写论文」「帮你算数字」,正在变成「自己做发现」。

医院里也是一样。2025年大量医院开始部署能从就诊对话自动生成临床记录的AI工具。多个医院系统的医生反馈,写病历的时间减少了多达83%,工作倦怠显著下降。

但同一份指数给医疗AI泼了一盆冷水。一份针对500多个临床AI研究的综述发现,将近一半的研究依赖考试题式的数据集,只有5%用了真实临床数据。

AI能减少医生敲键盘的时间,这件事是确定的。AI在真实病人身上的临床价值,目前还有大量问号。

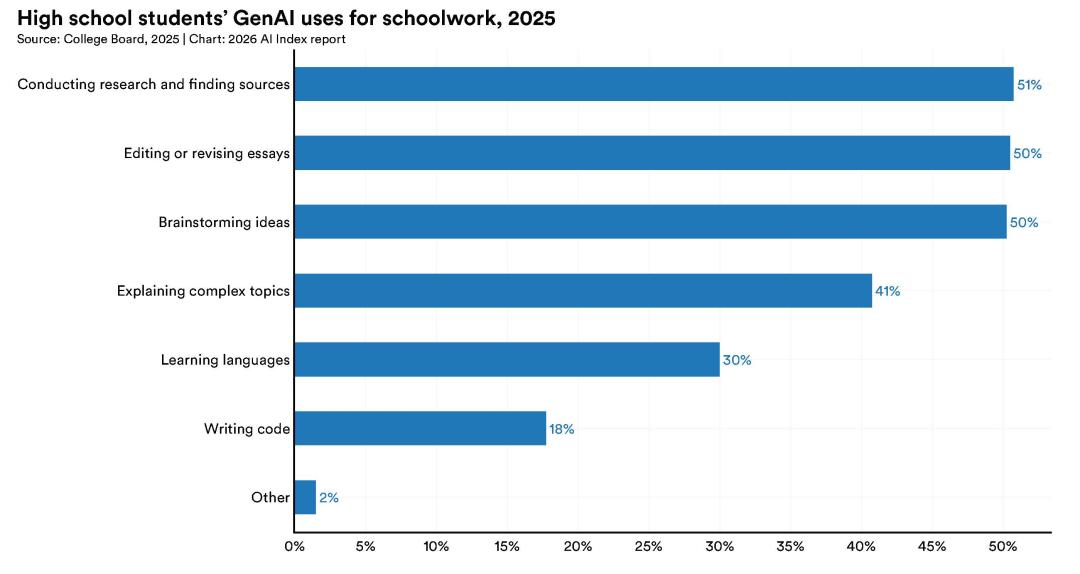

自学浪潮全球开炸

正规教育已经掉队

正规教育跟不上AI了。

美国有4/5的高中生和大学生现在用AI完成学校作业。但只有一半的中学有AI使用政策,只有6%的老师认为这些政策写得清楚。

学生跑在前面,老师还在原地,规则还没出现。

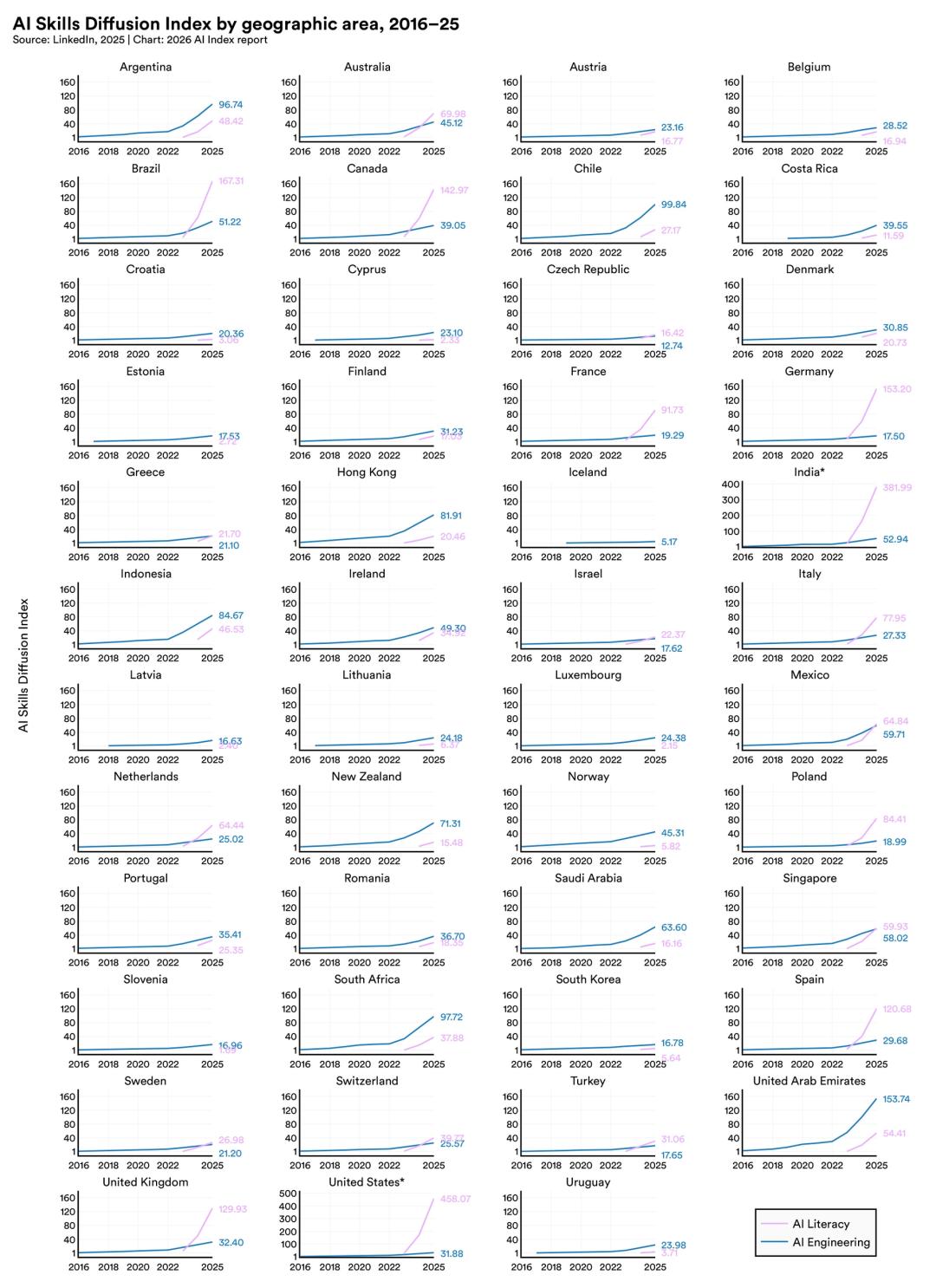

正规教育跟不上的同时,自学浪潮在全球开炸。里面写,学AI工程技能增长最快的三个国家分别是阿联酋、智利和南非。

不是美国,不是欧洲。

技能曲线的最陡峭的那一段,长在所有人都没在看的地方。

最强模型变成最不透明的

专家和公众撕裂

最强的模型,正在变成最不透明的模型。

Foundation Model Transparency Index今年的平均分从去年的58分跌到了40分。AI Index直接点名,谷歌、Anthropic、OpenAI都已经放弃公开最新模型的训练数据规模和训练时长。

去年发布的95个最具代表性的模型里,80个没有公开训练代码。

公众的情绪也变得更复杂。

全球范围内,认为AI利大于弊的比例从52%上升到59%。但同期,对AI感到紧张的比例从50%上升到52%。

两个方向在同时增长。

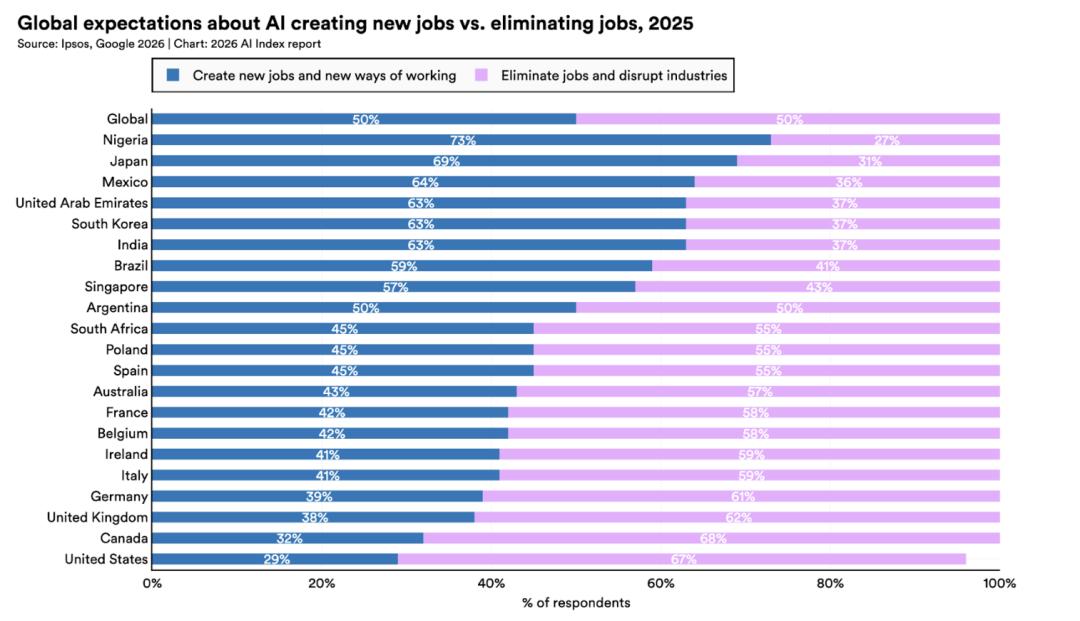

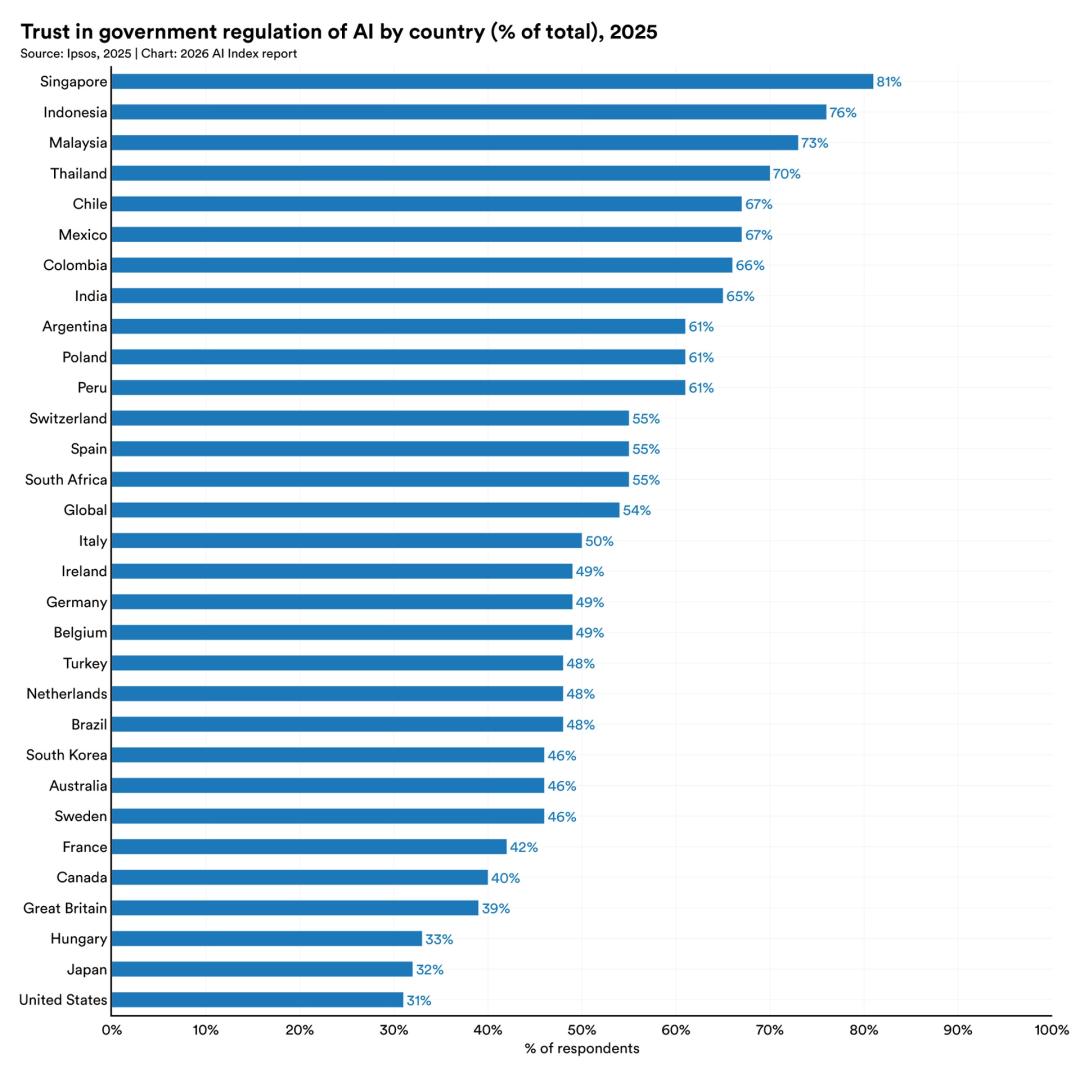

最分裂的是美国。只有33%的美国人认为AI会让自己的工作变得更好,全球平均是40%。美国人对本国政府监管AI的信任度,是受访国家里最低的,31%。

新加坡人对自己政府监管AI的信任度,是81%。

最近Sam Altman家被袭击的事件之后,硅谷圈内人「惊讶地发现」Instagram评论区里的普通人对此并不同情,甚至有人觉得「应该更激烈一点」。

他们没意识到事情已经糟到这个程度。

研报引用的Pew和Ipsos数据,专家和公众在AI影响就业、医疗、经济这些维度上的观感差距,普遍超过30个百分点,最大的一项达到50个百分点。

一边是实验室里的曲线在飞涨,一边是普通人心里的不安在累积。

中间没有桥。

写在最后

423页的报告里有几百张图表,但其实只画了一张图。

横轴是时间,纵轴是能力。

模型能力的曲线在飞,算力曲线在飞,投资曲线在飞,采用率曲线在飞。其他全都在原地踏步或者向下。

这就是2026年AI Index的全部内容。

AI在加速。其他所有东西都在脱节。

如果你是这个行业里的人,现在该问的问题不是「未来会怎样」,而是「自己站在哪一条曲线上」。

参考资料:

https://hai.stanford.edu/ai-index/2026-ai-index-report

https://hai.stanford.edu/news/inside-the-ai-index-12-takeaways-from-the-2026-report

https://www.nature.com/articles/d41586-026-01199-z

https://hai.stanford.edu/assets/files/ai_index_report_2026.pdf