一觉醒来,中美AI模型差距快没了??

仔细一看才知道,这竟然还是斯坦福HAI最新发布的《2026年AI指数报告》给出的结论。

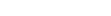

中美AI模型性能差距已基本消除(effectively closed)。

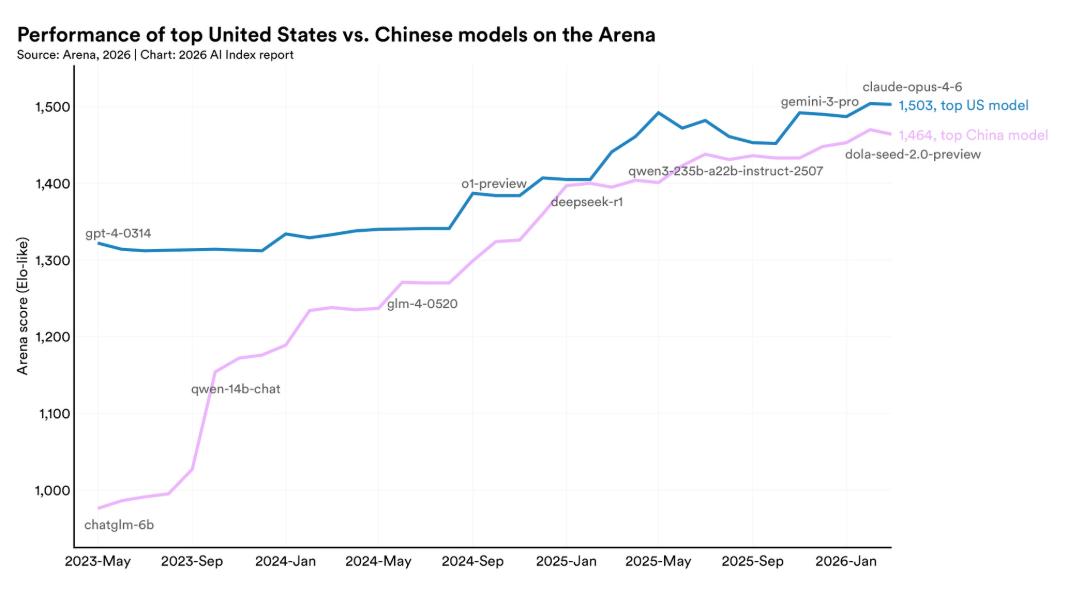

(粉色代表中国,蓝色代表美国,模型差距逐渐缩小)

除了谈中美,报告还一口气给出了14个重要观察或结论,它们共同回答了一个问题:

过去一年,AI又把我们带到了怎样的世界?

如果你也想知道答案,不妨一起往下看。

(天啦撸,报告原文有423页,所以咱们直接挑重点gogogo)

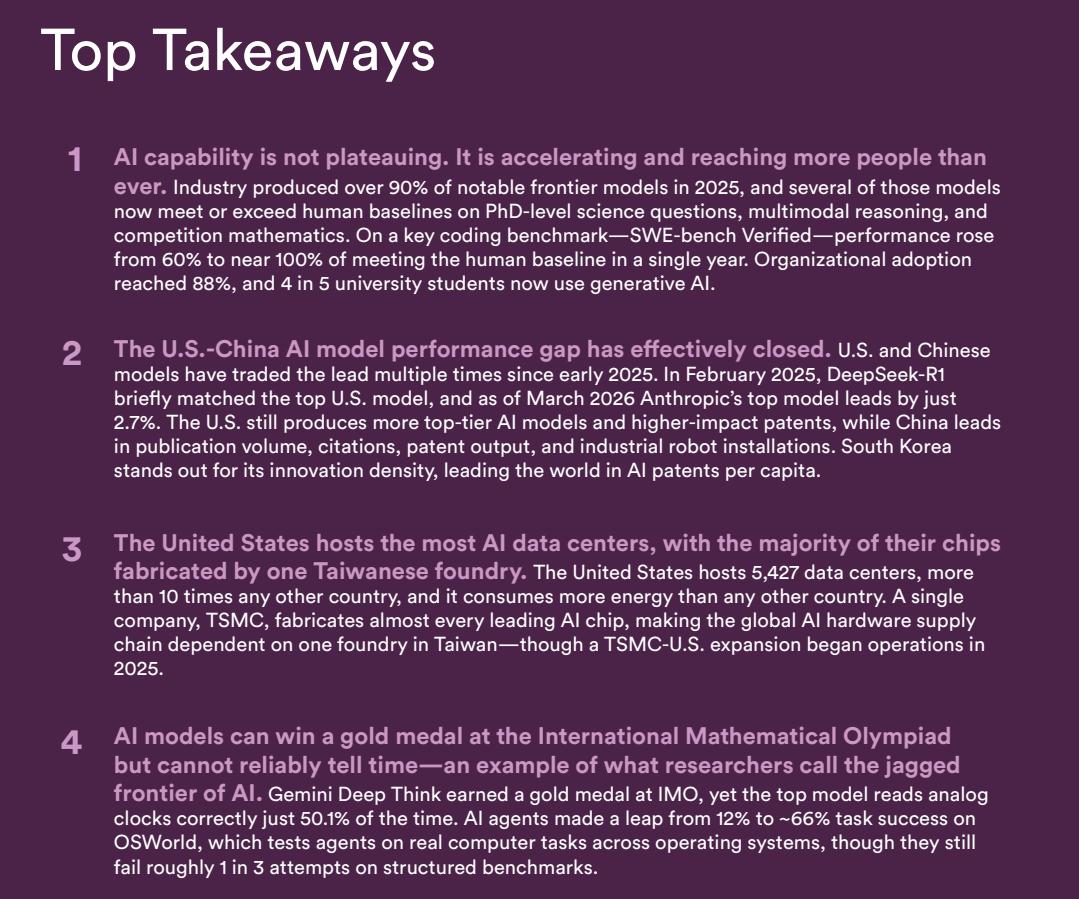

报告得出的15个主要结论

“Scaling Law见顶”争议下,AI发展不停

首先,报告从整体上给出了一个趋势判断:

AI能力并未停滞不前,它正在加速发展,并触达比以往更多的人。

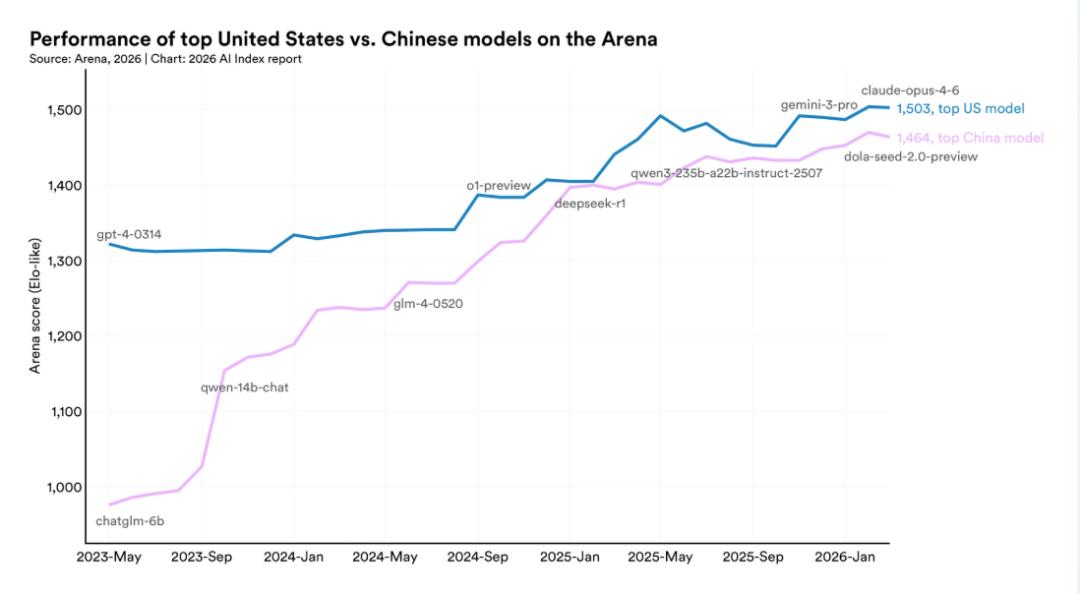

这体现在AI对困难任务的解决上:

2025年,业界生产了超过90%的知名前沿模型,其中多个模型在博士级科学问题、多模态推理和竞赛数学方面现已达到或超越人类基线。

而且在SWE-bench Verified这个关键的编码基准测试上,模型性能在一年内从60%提升至接近100%。

与此同时,AI也在迅速普及开来:

企业端的采用率已经达到88%,而在大学生群体中,五分之四的人已经在使用生成式人工智能。

中美AI模型性能差距已基本消除

至于中美,则从2025年初以来呈现“你方唱罢我登台”的局面。

2025年2月,DeepSeek-R1横空出世,短暂追平美国顶尖模型。

截至2026年3月,Anthropic的顶尖模型虽仍保持领先,但优势已收窄至仅2.7%。

在产出层面,美国依然拥有更多顶级AI模型和更高影响力的专利,而中国则在论文发表量、引用量、专利总数及工业机器人安装量上占据优势。

此外,韩国凭借其创新密度脱颖而出,人均AI专利数量位居全球第一。

AI数据中心美国最多,台积电赢麻了

关于巨头们都在押注的AI数据中心,目前美国拥有绝对数量优势——

有5427个数据中心,数量是其他任何国家的10倍以上(不过能源消耗也超过其他任何国家)。

而且在芯片制造方面,台积电简直赢麻了:

几乎每一款领先的AI芯片都由台积电一家公司制造,这使得全球AI智能硬件供应链依赖于中国台湾省的一家代工厂——尽管台积电在美国的扩建项目已于2025年投入运营。

AI能拿奥数金牌,但还是看不懂时间

过去一年,AI能力依旧参差不齐。

国际前沿模型Gemini Deep Think可以在IMO中拿下金牌,但当前顶尖模型在读取指针式时钟时,准确率却只有50.1%。

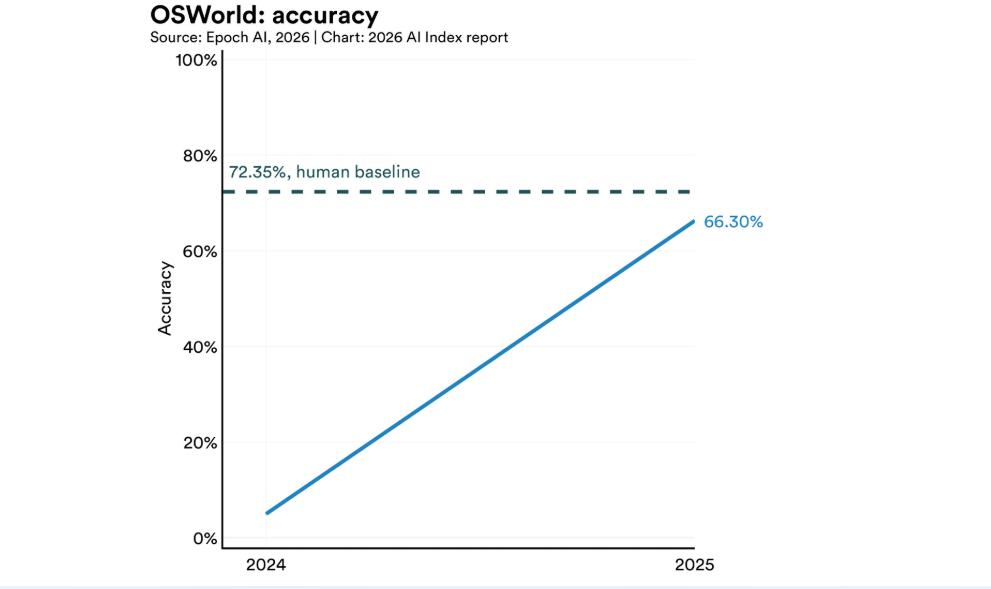

与此同时,AI Agent的能力也在快速进化:

在OSWorld这一覆盖多操作系统真实任务的测试中,任务成功率从12%跃升至约66%。

不过即便如此,在结构化基准测试中,它们仍然大约有三分之一的任务会失败。

AI安全基准滞后,安全事故频发

如今,几乎所有头部前沿模型开发者,都会主动披露模型在能力基准测试上的成绩。

但在“负责任的AI”这件事上,信息依然零散且不完整,缺乏系统性的披露。

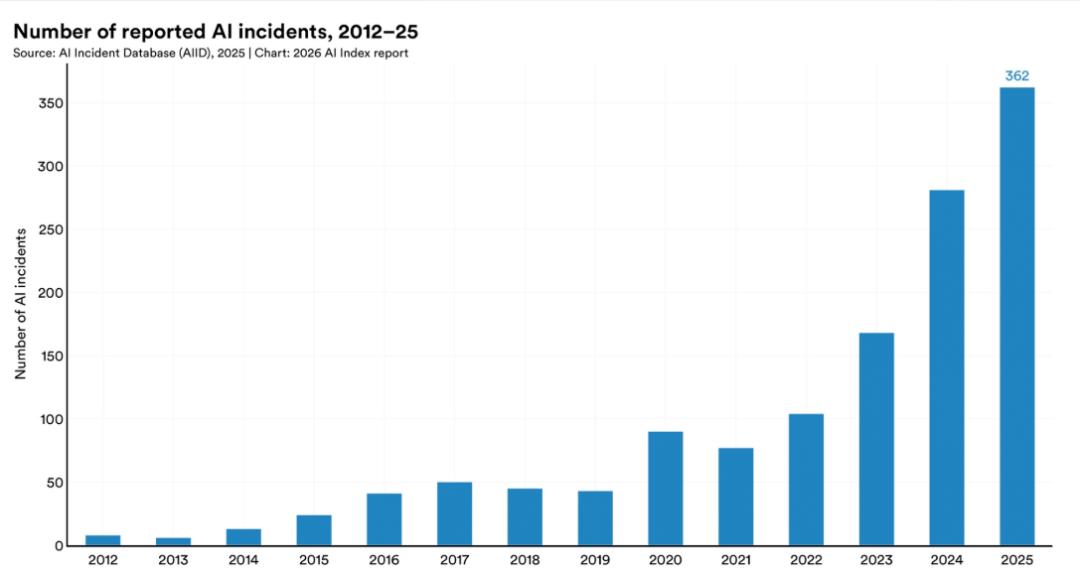

与此同时,风险信号也在变多——

被记录在案的AI事件数量,从2024年的233起,上升到了362起。

更棘手的是,最新研究还发现:

在负责任的AI中,不同目标之间可能存在“此消彼长”,比如提升安全性,往往会以牺牲准确性为代价。

美国在AI投资方面领先,但对全球人才的吸引力正在下降

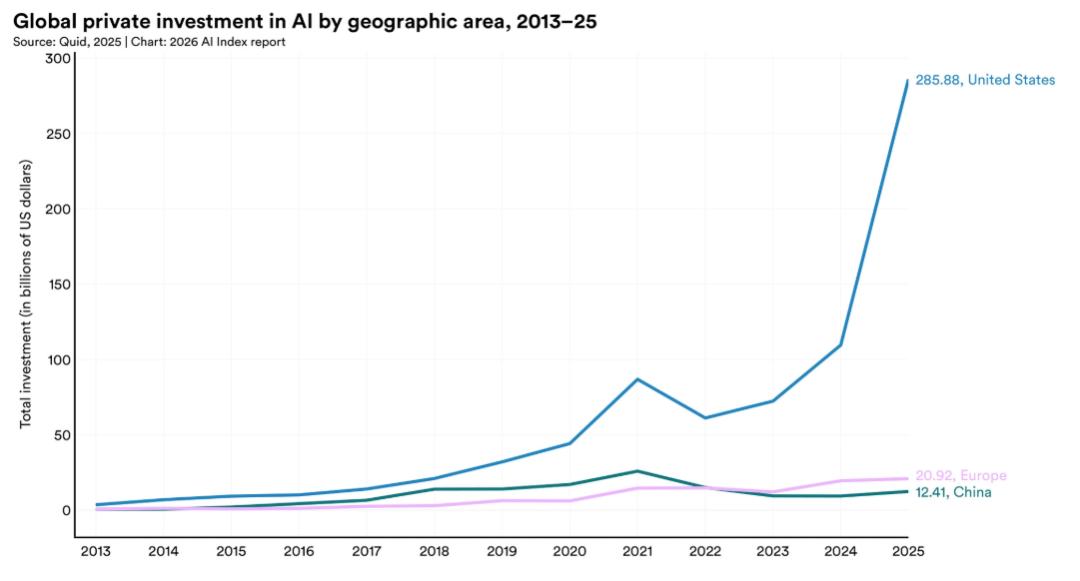

2025年,美国在AI上的私人投资达到2859亿美元,规模是中国124亿美元的23倍以上。

不过报告提醒,单看私人投资大概率会低估中国的整体投入——

因为中国还有大量来自政府引导基金的支持。

在创业活跃度上,美国领先中国:

一年内获得新融资的AI公司达到1953家,数量是第二名国家的10倍以上。

但另一边,美国这边也出现了一个不太乐观的趋势——

流向美国的AI研究人员和开发者,正在明显减少。

自2017年以来,这一数字已经下降了89%;仅过去一年,就又减少了80%。

AI普及率正在历史性加速

AI普及率正在历史性加速。

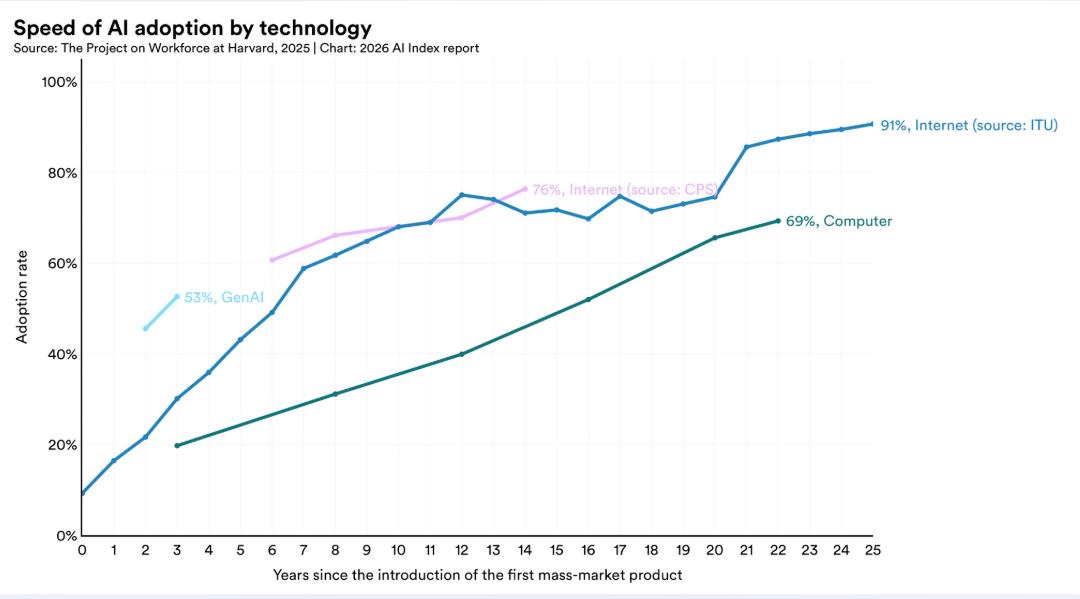

仅用三年时间,生成式AI就触达了53%的人口,普及速度明显快于PC和互联网。

不过,这一进程在不同国家之间差异明显,并且与人均GDP高度相关。

其中,新加坡的普及率达到61%,阿拉伯联合酋长国为54%;相比之下,美国仅为28.3%,排名第24位。

此外,从价值角度看,体感也在迅速放大——

到2026年初,生成式AI工具为美国消费者创造的年价值,已经达到1720亿美元。

而从2025年到2026年,单个用户的中位价值直接翻了三倍。

换句话说,哪怕很多工具本身是免费的,但普通消费者正在从中拿到真金白银的价值。

当前正规教育跟不上AI发展的速度

虽然AI发展很快,但正规教育体系,当前明显有点跟不上了。

学生这边已经全面上手:

在美国,超过80%的高中生和大学生,已经在用AI完成学习相关任务。

但另一边,学校体系却还没准备好——

美国只有一半的中小学制定了AI相关政策,而在教师群体中,只有6%的人认为这些政策是清晰的。

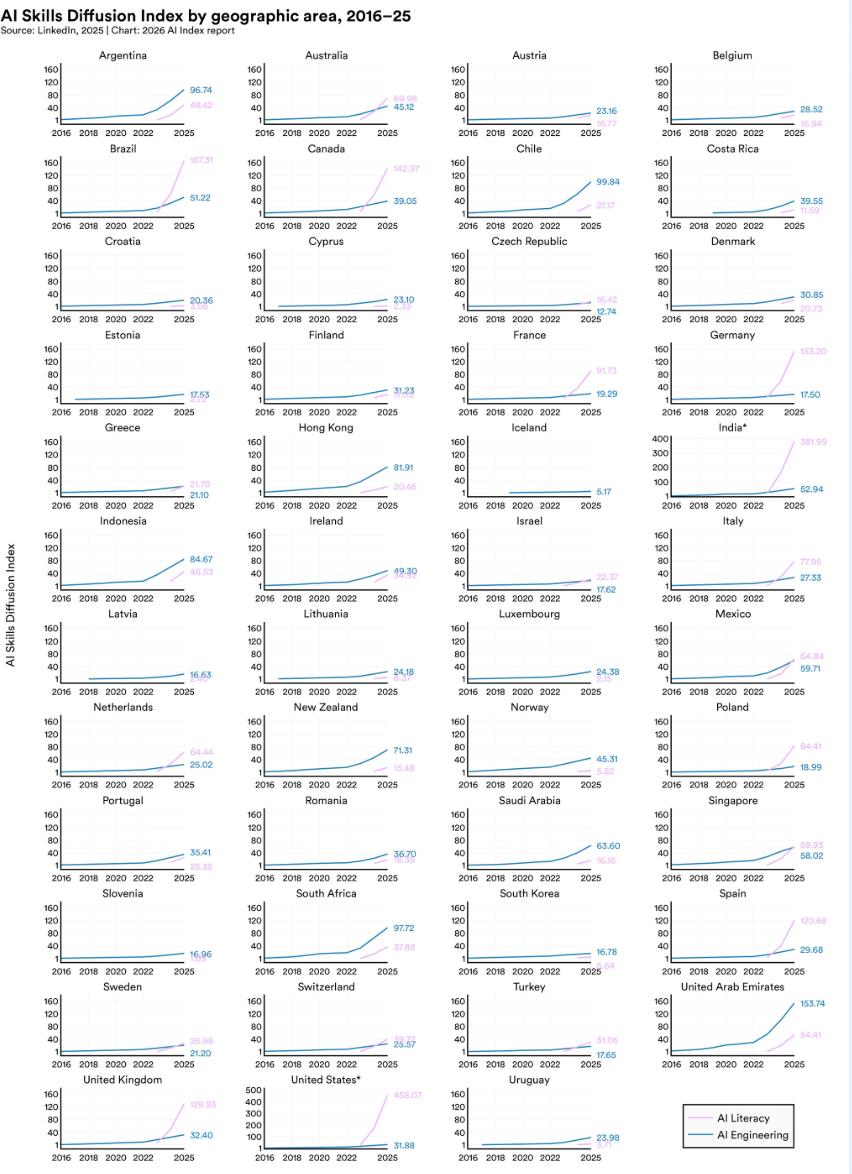

在全球范围内,AI工程技能增长最快的国家,反而是阿拉伯联合酋长国、智利和南非。

与此同时,人才供给也在变化:

从2022年到2024年,美国和加拿大新增的AI博士数量增长了22%,但这些新增博士,更多流向了学术界,而不是工业界。

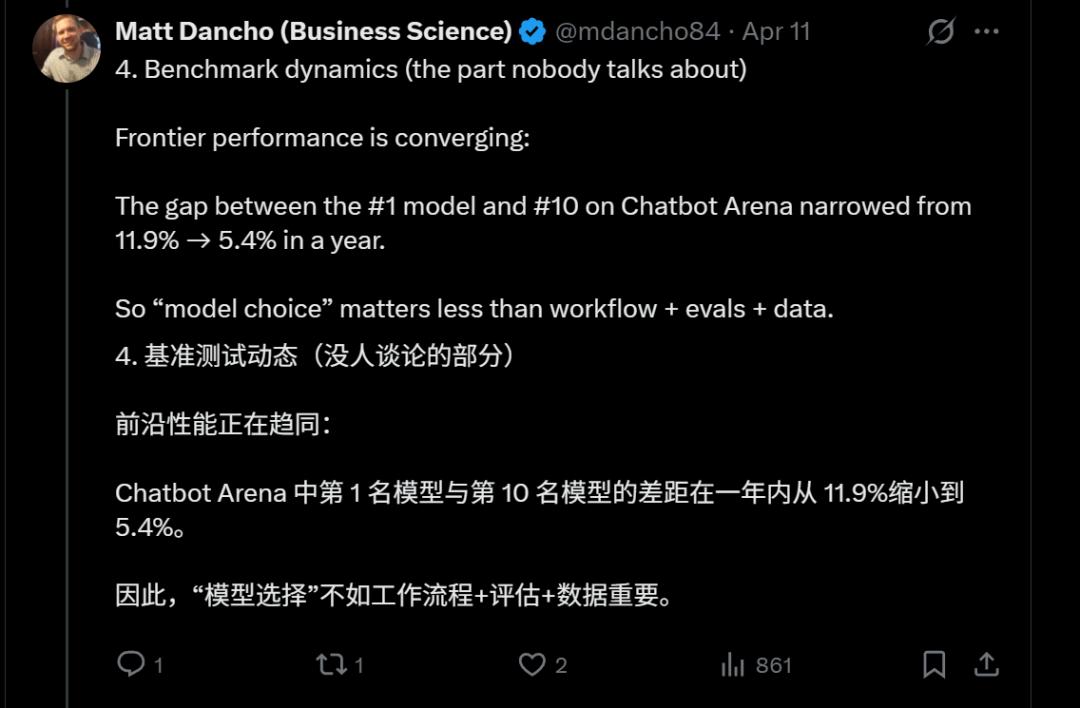

开源正在成为全球AI竞争新变量

如今,越来越多国家开始加码布局AI。

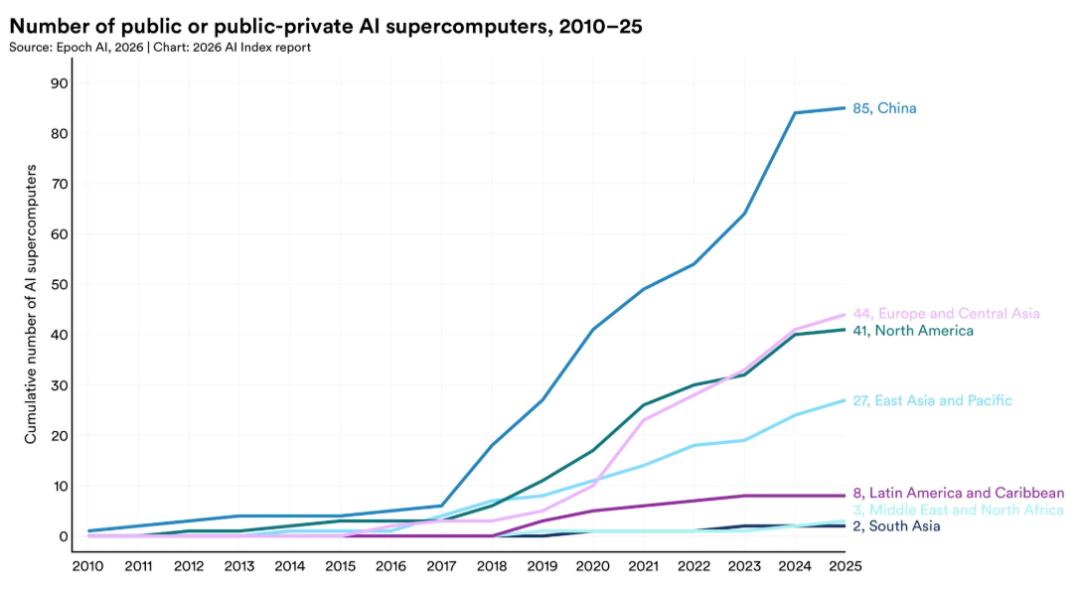

为了把AI能力尽量掌握在本土体系内,发展中经济体持续扩展国家级AI战略,同时政府主导的AI超级计算投资也在同步增长。

但现实是,核心能力依然高度集中:

无论是模型研发还是前沿突破,仍主要掌握在美国和中国手中。

不过,一个新的变量正在出现——开源。

随着开源生态的发展,参与者的版图开始被重新分配。

在GitHub上,来自“其他地区”的贡献量,已经超过欧洲,并逐渐逼近美国。

更重要的是,这种变化正在带来连锁反应:

更多语言、更丰富场景的模型与评测体系,开始出现。

关于AI的未来,专家和普通人的看法正在明显“分叉”

在“AI会如何影响工作”这个问题上,73%的专家认为是正面的,但公众中只有23%这么看,两者之间拉开了整整50个百分点的差距。

类似的分歧,也出现在对经济、医疗等关键领域的判断上。

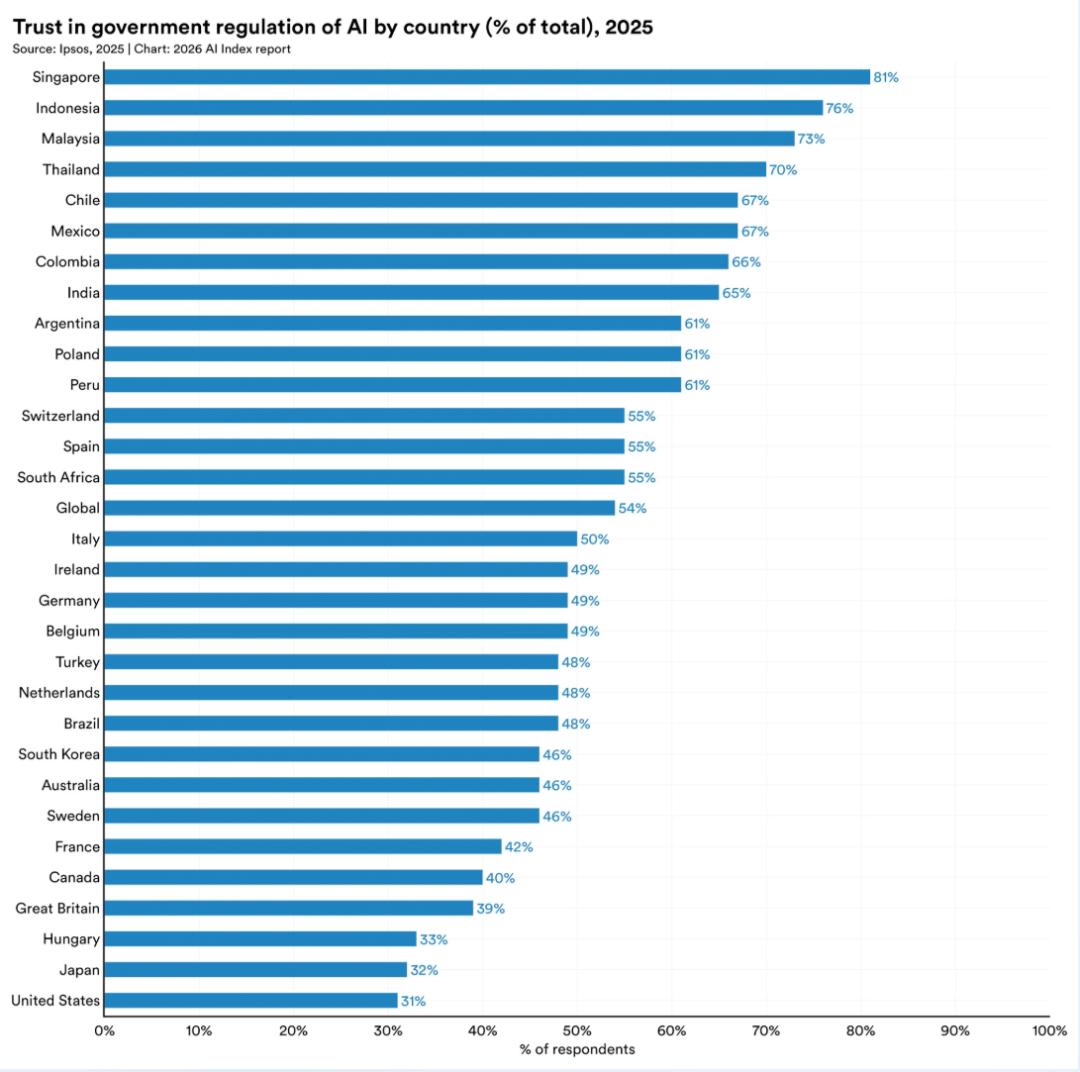

信任层面,不同国家之间,对政府监管AI的信任度差异明显。

在受调查国家中,美国的信任度最低,只有31%。

而从全球范围来看,欧盟在“能否有效监管AI”这件事上,整体信任度要高于美国和中国。

除了上面这10个,斯坦福官网未列但报告里提到的其他5个结论分别是:

1、即使在受控环境中表现出色,机器人仍无法完成大多数家务任务(仅12%)。

2、AI先替代的是“入门级执行”,而不是“有经验的判断”。从2024年开始,美国22~25岁的年轻开发者岗位,直接少了近20%;但与此同时,年长开发者反而在增加。

3、AI能力在变强,但环境代价也在同步放大。仅GPT-4o推理的年用水量,就可能超过1200万人的饮用水需求。

4、AI在科学领域,已经开始超越人类,但模型越大,并不总是越强。

5、AI正在快速进入临床一线,但仍缺乏有效性。一项覆盖500多项研究的综述显示,接近一半的研究,依赖的是示例性问题,而不是真实患者数据;真正基于真实临床数据开展的研究,占比只有5%。

(具体指路第9页)

斯坦福HAI出品、谷歌OpenAI提供支持

最后简单说一下,《斯坦福AI指数报告》到底是什么来头。

除了出品方斯坦福HAI,其支持者阵容可谓相当豪华:

不仅有谷歌、OpenAI这样的头部模型玩家,而且还有麦肯锡、GitHub、领英等强大数据提供方。

对了,“以人为本”人工智能实验室(HAI)还是李飞飞发起并联合创立的,之前她通常以“代言人”的身份宣传介绍这份报告,不过今年推特暂无动静。

翻了下报告指导委员会名单,里面也没有她的身影(而且也没有华人)。

(难道这和她投身创业有关?)

而从2017年开始,这些顶尖研究人员和机构就聚在一起专门做一件事:

用数据,把AI每年怎么发展这件事讲清楚。

多年下来,该报告已经成为业界重要参考(今年已经是第9份了)。

相比之前,报告今年还明显增加了一个信号:AI已经不只是技术问题,而是开始全面进入深水区。

一方面,它持续追踪AI在推理能力、安全性、以及真实世界任务中的表现,但一个关键变化是——

这些指标本身,正在变得越来越不可靠。

另一方面,报告首次给出了生成式AI的经济价值新估算,并补充了对劳动力市场影响的最新证据——

AI不再只是“会不会取代人”的问题,而是已经开始重塑岗位结构。

更宏观的部分也在展开,比如提出了一个分析国家层面技术控制与竞争的新框架、首次单独设立AI科学/AI医学两大板块、与谷歌前CEO施密特的公司合写科学章节。

Anyway,如果你也关心AI的近况和未来——

这份报告或许就是目前信息密度最高、值得每年一追的那一个。

(好好好,我将深度学习之)

报告原文:https://hai.stanford.edu/ai-index/2026-ai-index-report